Краткий курс теории обработки изображений

Информация в данной статье относится к релизам программы MATLAB ранее 2016 года, и поэтому может содержать устаревшую информацию в связи с изменением функционала инструментов. С более актуальной информацией вы можете ознакомиться в разделе документация MATLAB на русском языке.

Краткий курс теории обработки изображений. Автор - И.М.Журавель.

Содержание:

- Свойства зрительной системы человека

- Возможности цифровой обработки изображений в Matlab

- Типы изображений

- Бинарные изображения: геометрические характеристики

- Бинарные изображения: топологические характеристики - Формирование и обработка цифровых изображений

- Локально-адаптивная обработка изображений

- Адаптивное повышение контрастности изображений

- Энтропия изображения. Использование среднеквадратического отклонения значений яркостей элементов окрестности в методах контрастирования изображений. Нелинейное растяжение локальных контрастов.

- Анализ некоторых характеристик локальных окрестностей

- Статистическое определение локального контраста

- Локально-адаптивное улучшение качества изображений - Фильтрация изображений

- Алгоритмы сглаживания изображений

- Двумерное сглаживание изображений

- Обобщенная линейная фильтрация

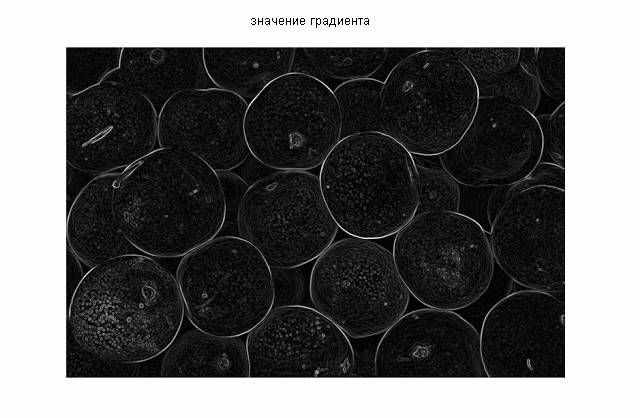

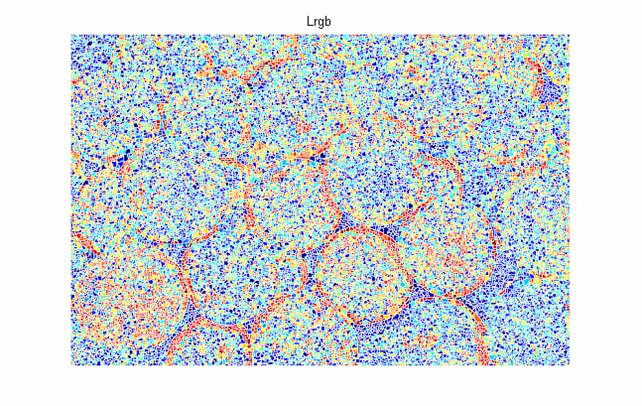

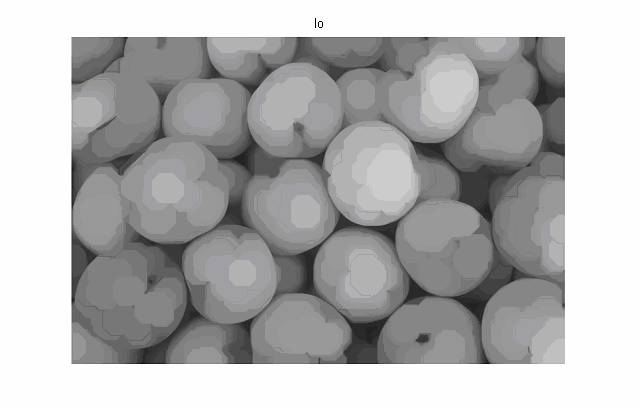

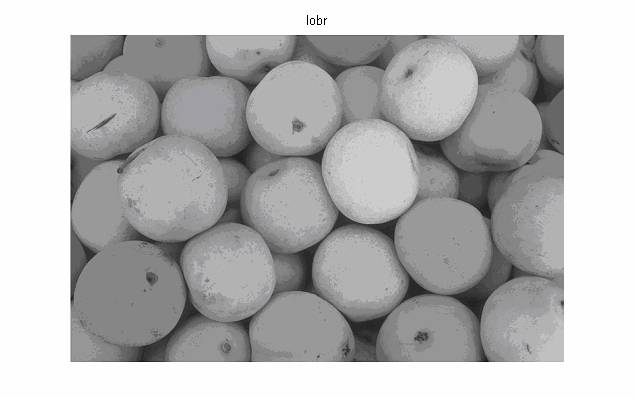

- Градиентный метод выделение контуров объектов на цветных изображениях

- Пространственная фильтрация - Деконволюция

- Предварительная обработка изображений - Расширение границ изображений. Сверхразрешение

- - Реконструкция размытых изображений в MATLABСтруктурное распознавание на основе меры схожести символьных строк

- Границы изображений

- Края и их обнаружение - Оптимизация палитры изображений

- Кодирование и сжатие изображений

- задачи кодирования

- основные методы кодирования - Некоторые области практического применения методов обработки изображений и распознавания образов (геофизические наблюдения, применение в биологии, применение на транспорте)

- Распознавание рукописных знаков

- Коррекция неравномерной засветки изображения.

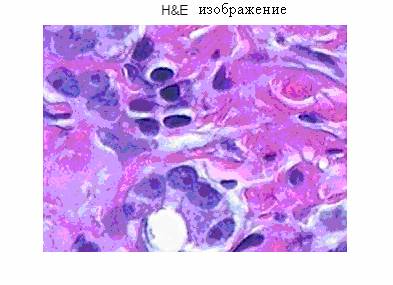

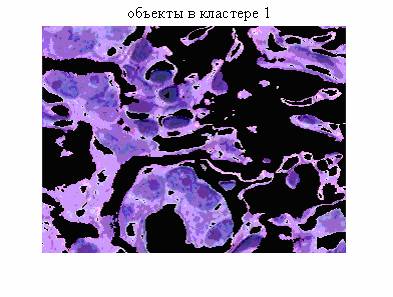

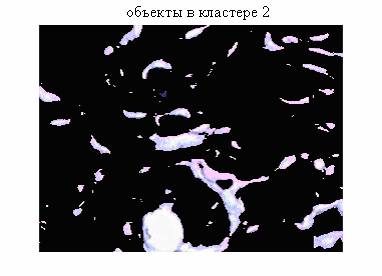

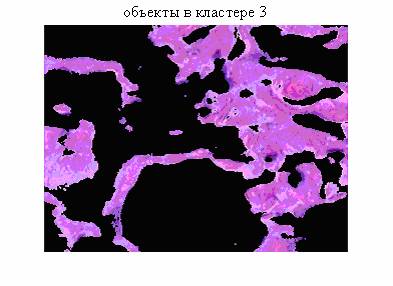

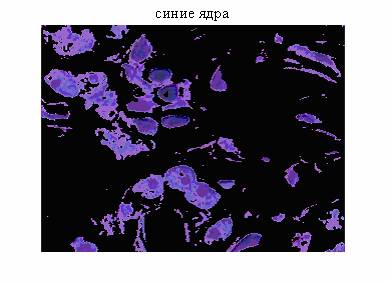

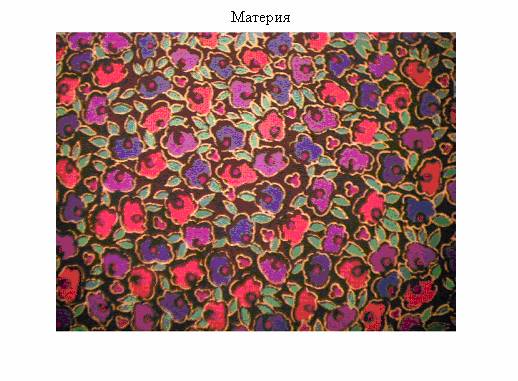

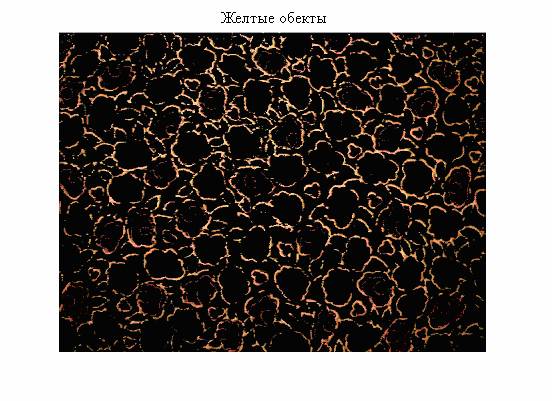

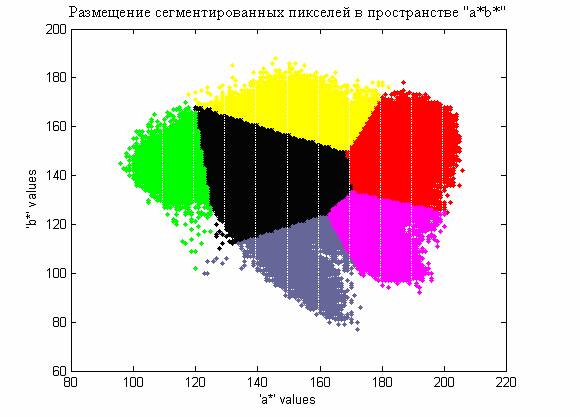

- Сегментация цветных изображений на основе кластеризации по методу k-средних.

- Сегментация цветных изображений на основе цветового пространства L*a*b*

- Уменьшение количества градаций цветных изображений

- Обнаружение вращений и масштабных искажений на изображении

- Регистрация изображений с помощью нормированной кросс-корреляции

- Наложение двух изображений

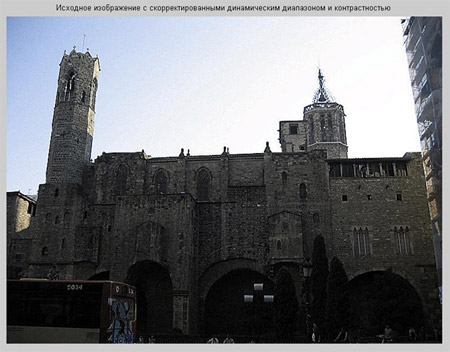

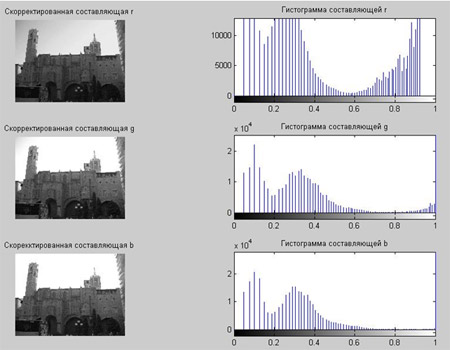

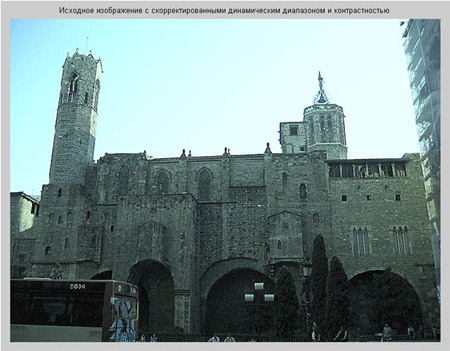

- Технология повышения контрастности изображений.

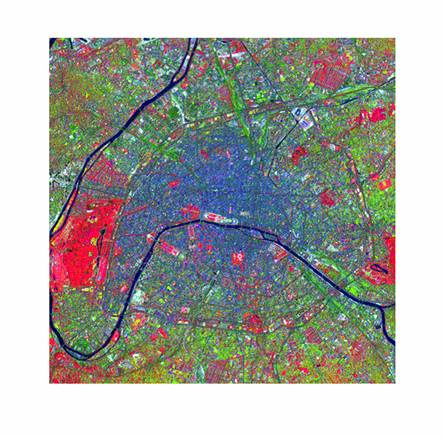

- Улучшение мультиспектральных цветных изображений

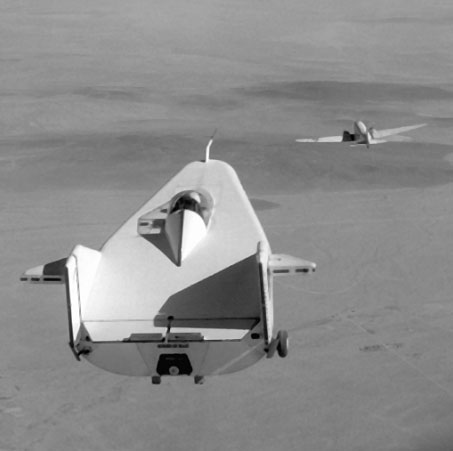

- Регистрация аэрофотографий на ортофотоснимках

- Пространственные преобразования изображений

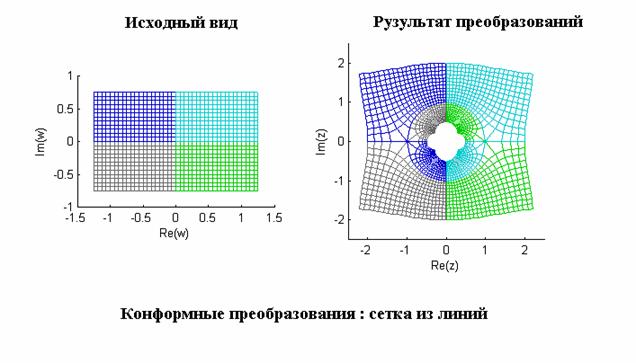

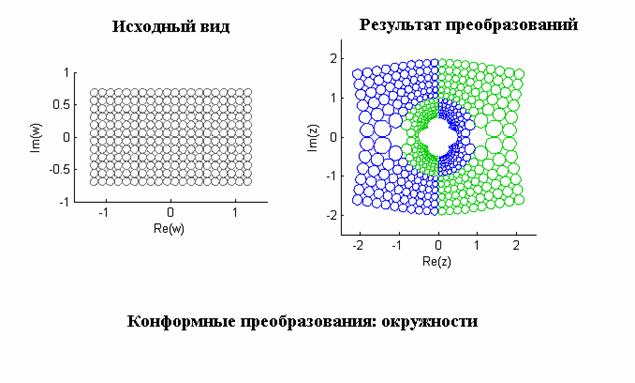

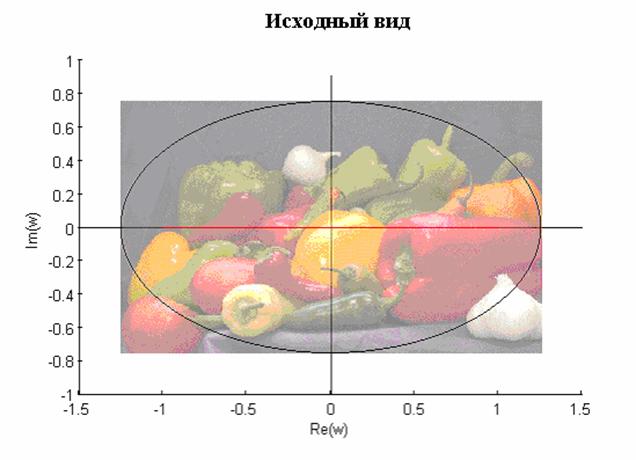

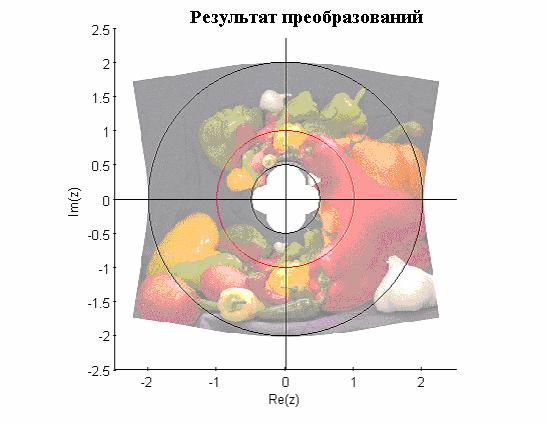

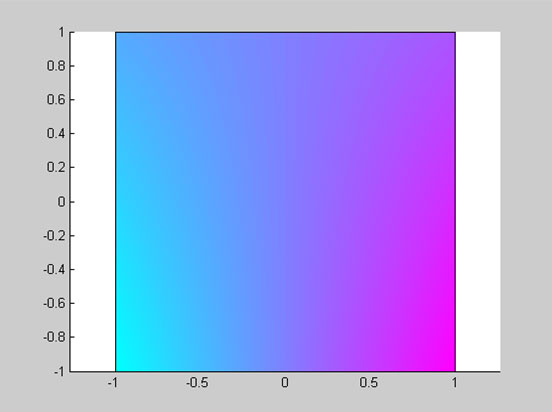

- Исследование конформных преобразований

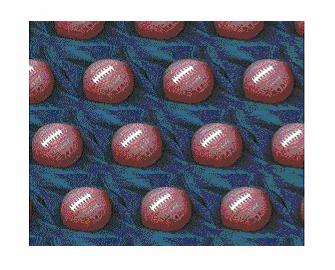

- Создание обивочных материалов с использованием изображений

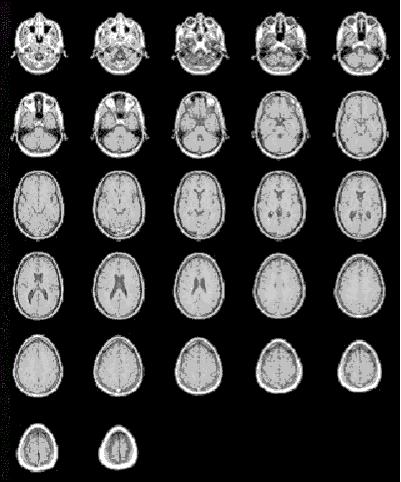

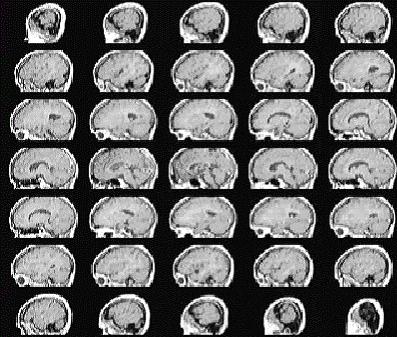

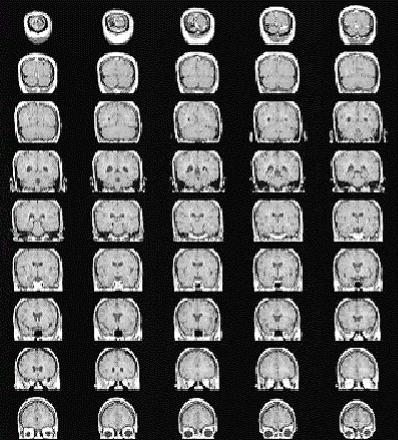

- Извлечение данных из трехмерных магниторезонансных изображений

- Поиск длины маятника в движении

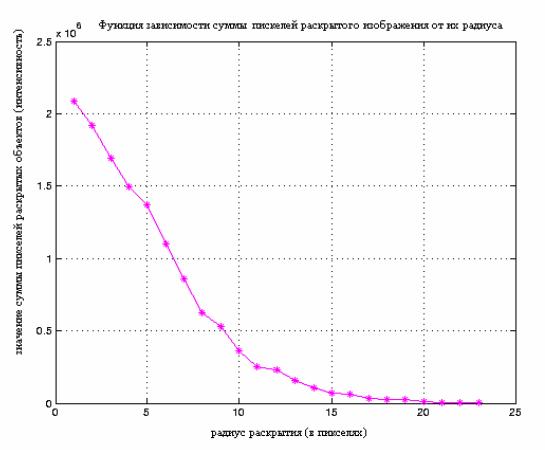

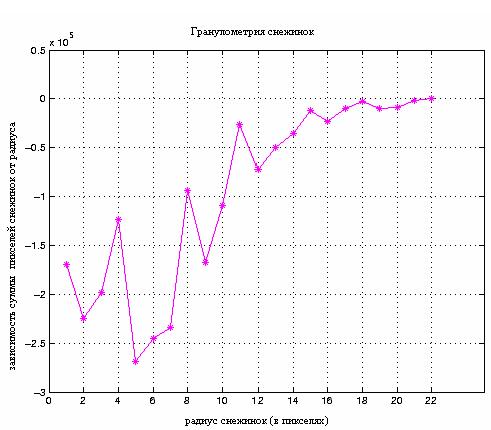

- Гранулометрия

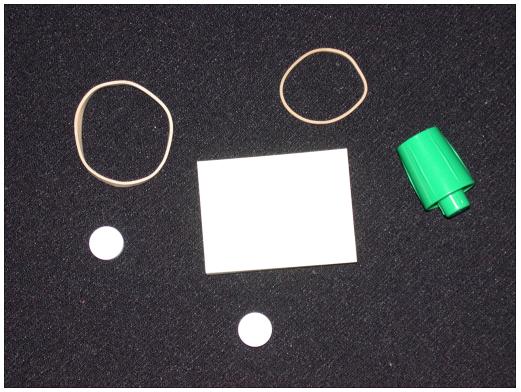

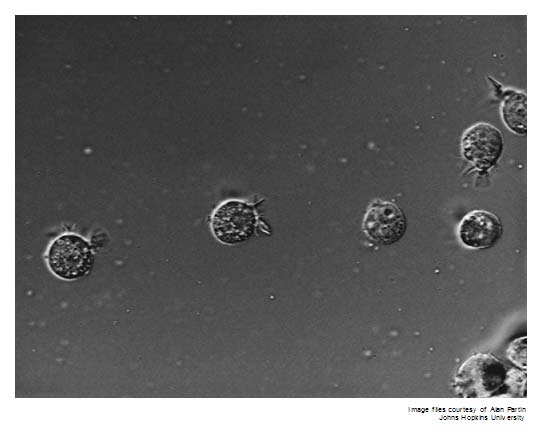

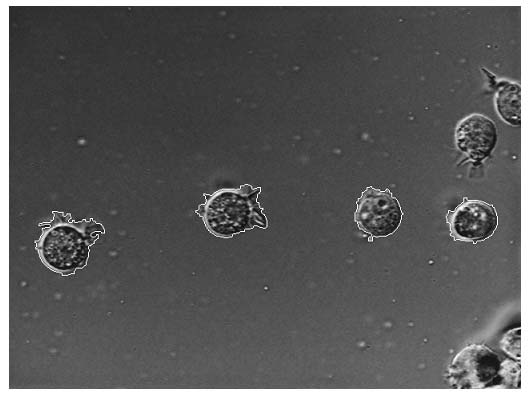

- Идентификация округлых предметов

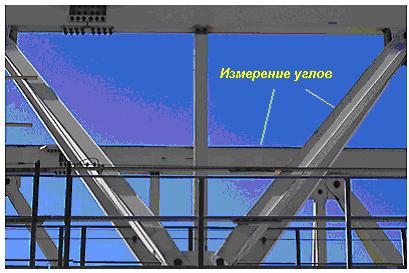

- Измерение углов пересечения

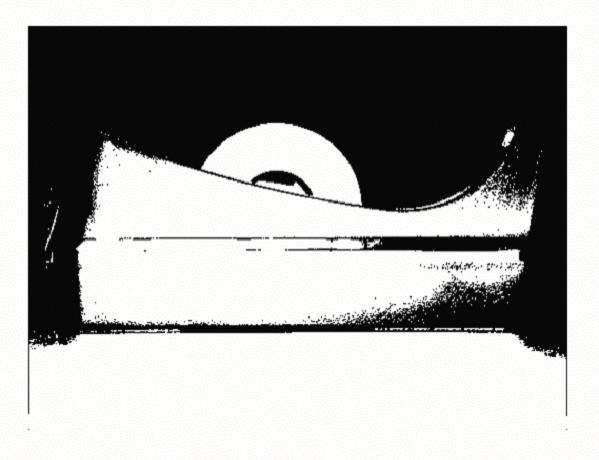

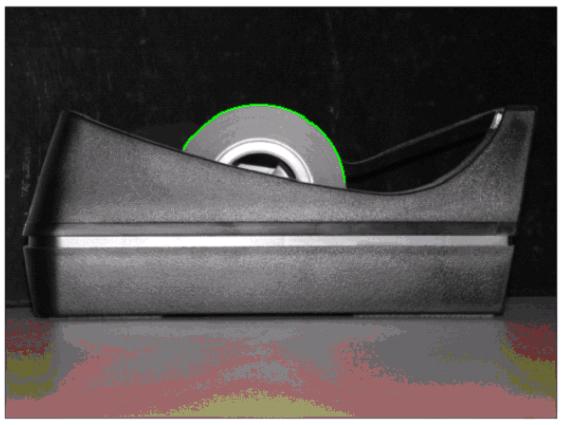

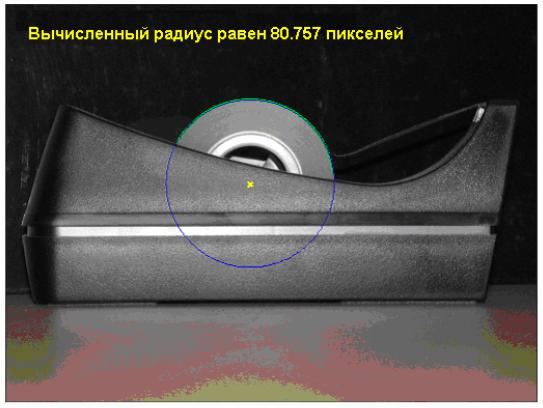

- Измерение радиуса части мотка ленты

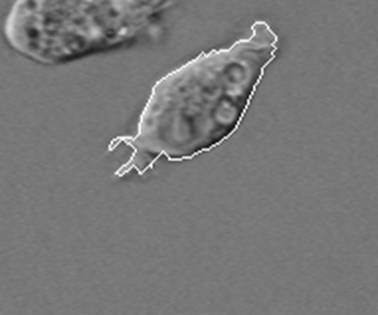

- Обнаружение объектов с помощью сегментации изображений

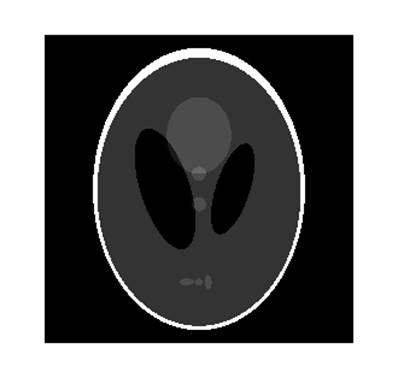

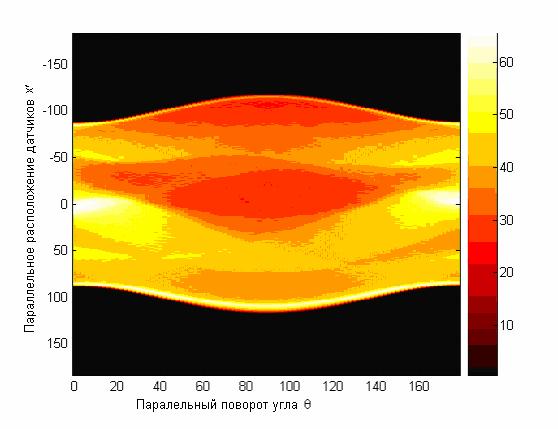

- Реконструкция изображений по их проекционным данным

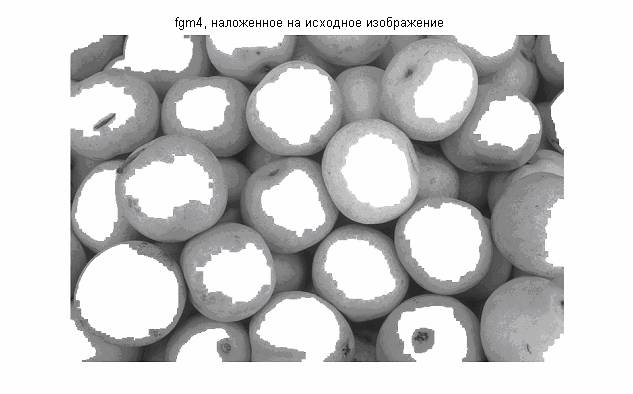

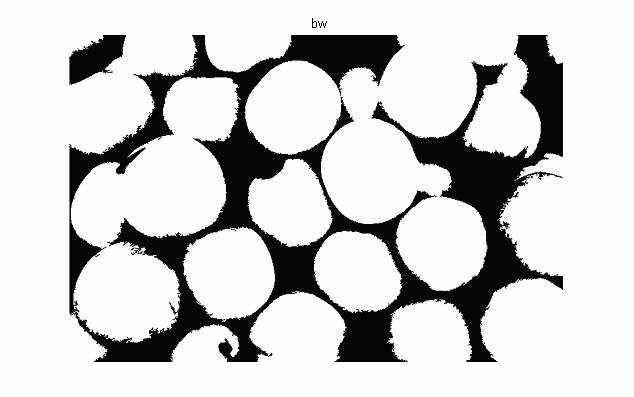

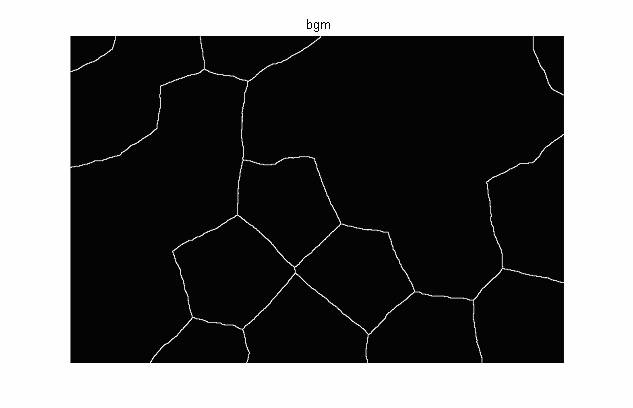

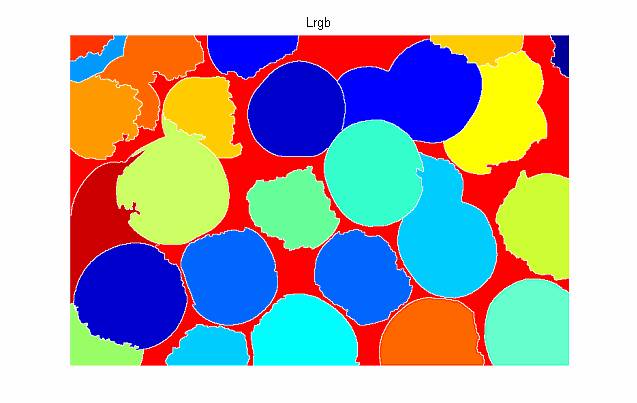

- Сегментация методом управляемого водораздела

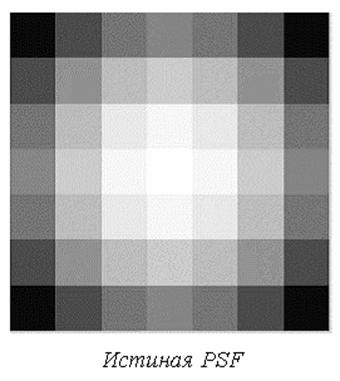

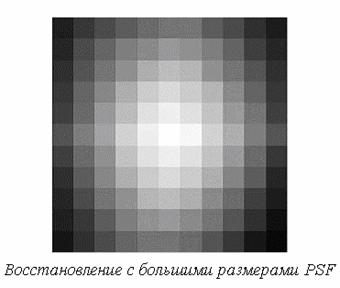

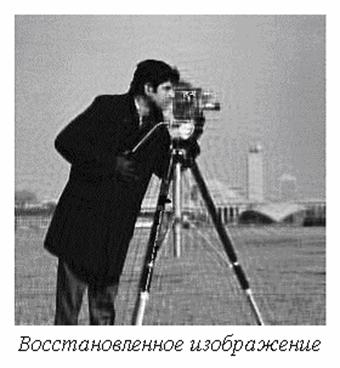

- Восстановление изображений методом слепой деконволюции

- Реконструкция изображений с использованием регуляризационного фильтра

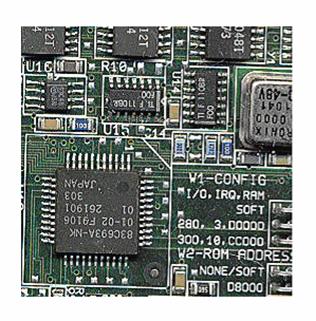

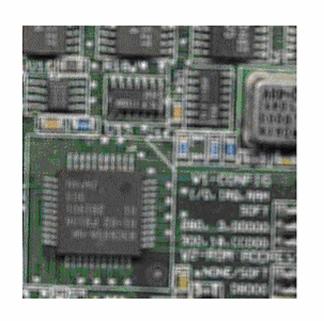

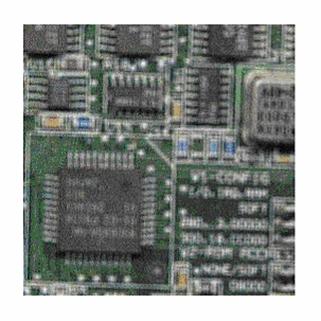

- Восстановление изображений с использованием метода Лаки-Ричардсона

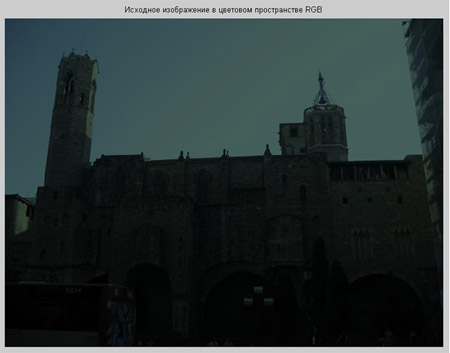

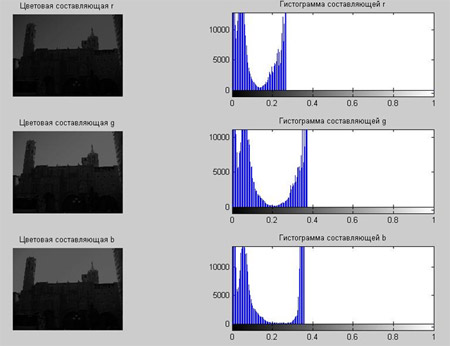

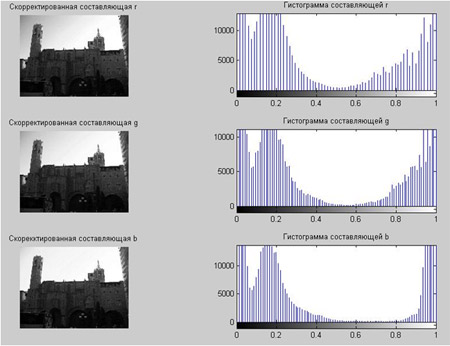

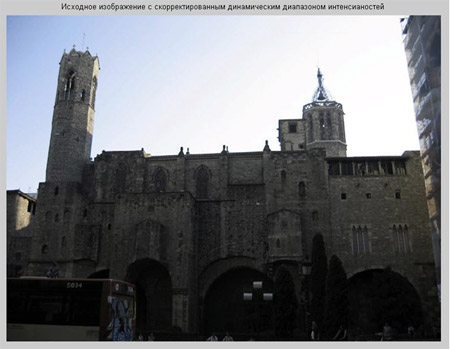

- Некоторые подходы к улучшению визуального качества изображений с затемненными участками

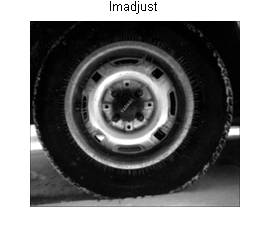

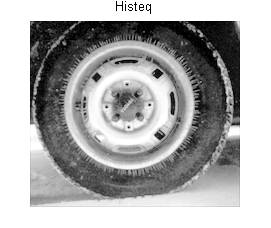

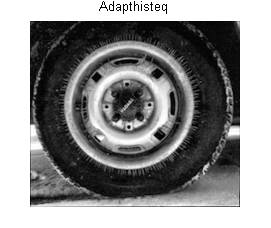

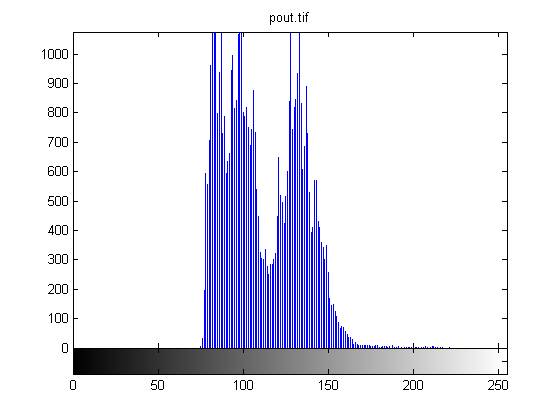

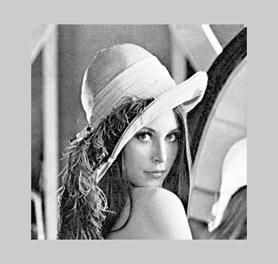

- Реализация некоторых методов видоизменения гистограмм в системе Matlab

- Подавление шумов на изображениях

- Текстурная сегментация с использованием текстурных фильтров

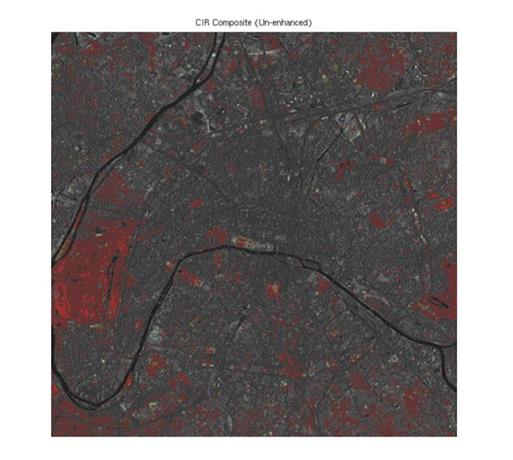

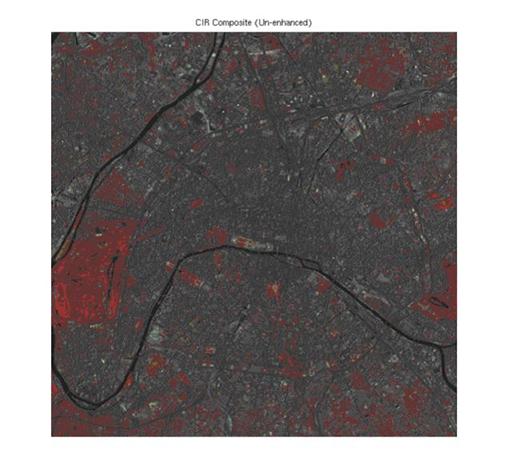

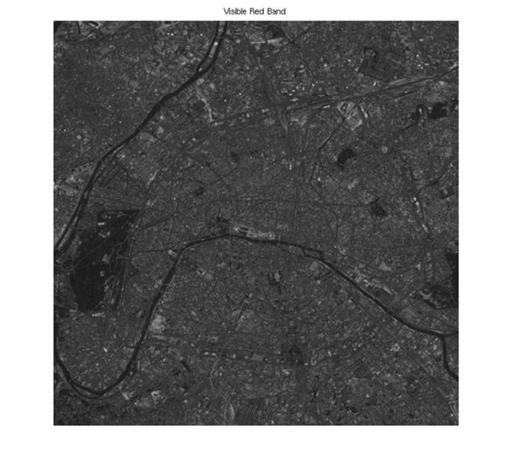

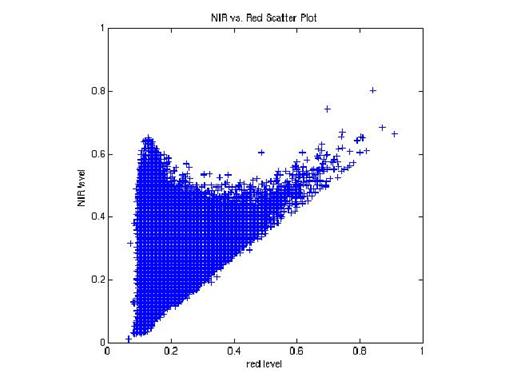

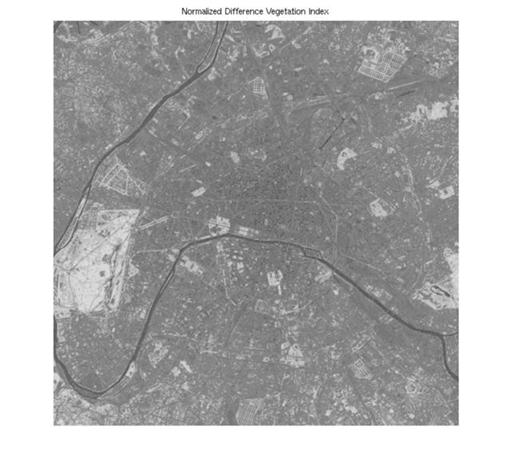

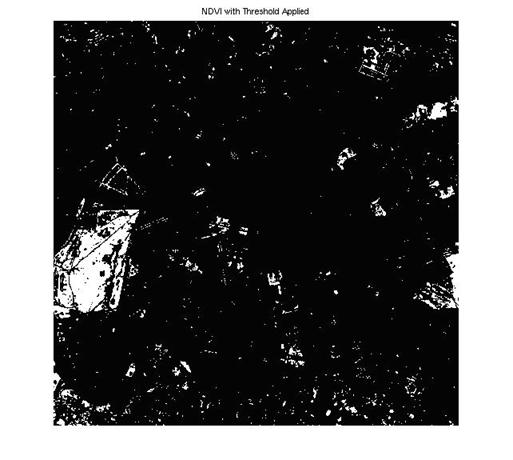

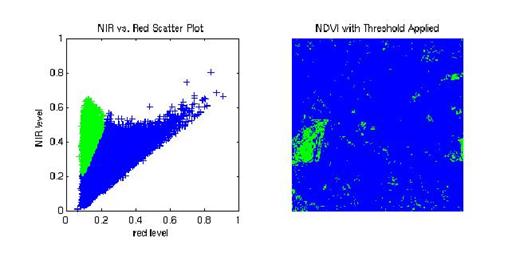

- Поиск растительности на мультиспектральных изображениях

- Распознавание объектов на основе вычисления их признаков

- Распознавание объектов на основе вычисления коэффициента корреляции

- Анализ признаков объектов

- Некоторые аспекты задачи распознавания номерных знаков автомобилей

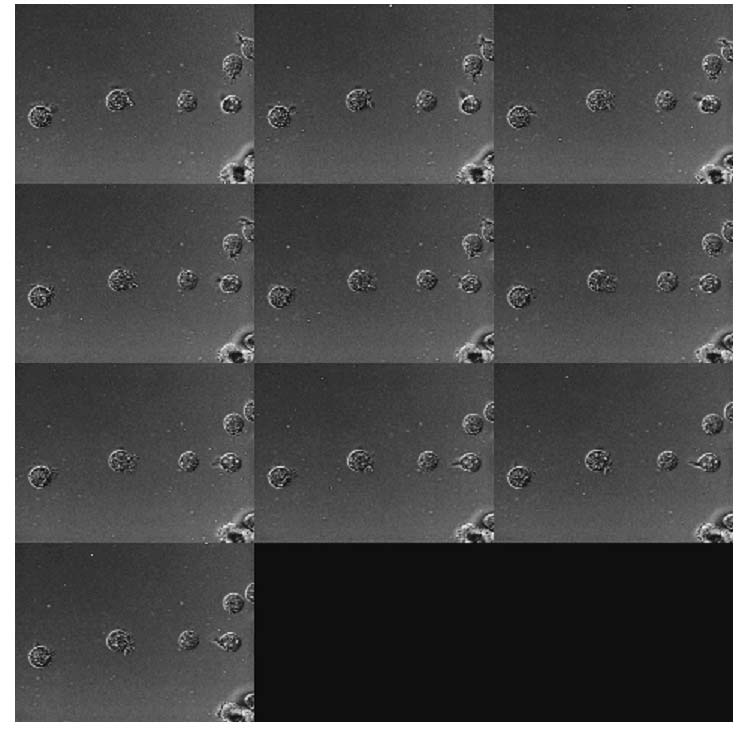

- Анализ серии изображений с распределенной обработкой данных

- Сглаживание цветных изображений

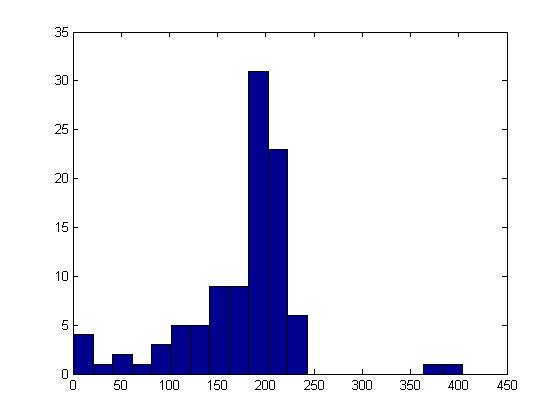

- Построение гистограмм

- Видоизменение гистограмм

Визуализация объектов - Применение методов улучшения изображений при разработке системы видеонаблюдения

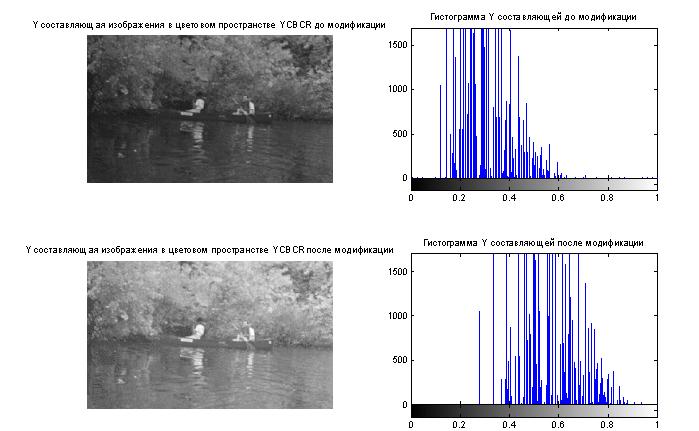

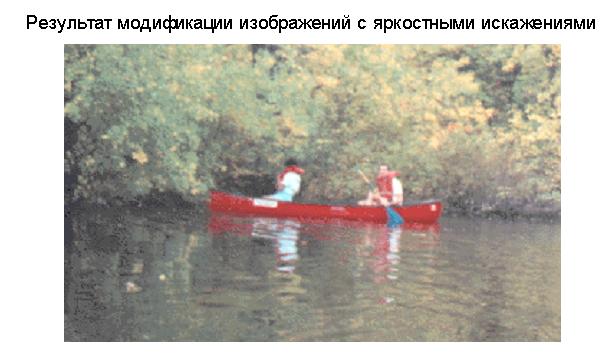

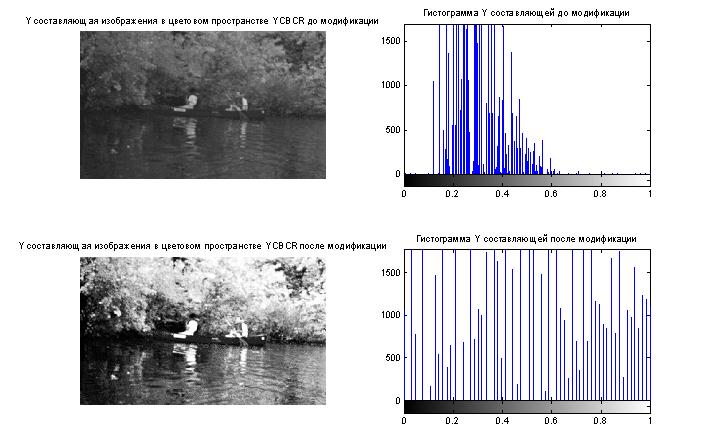

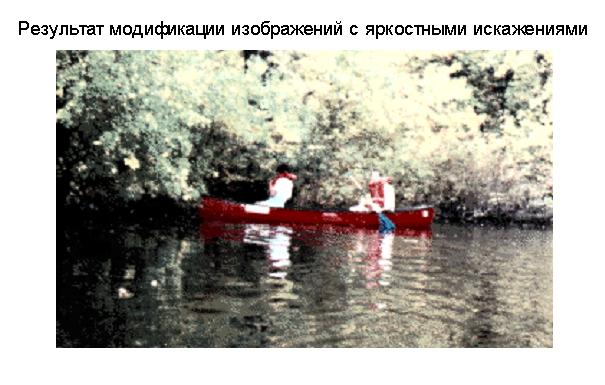

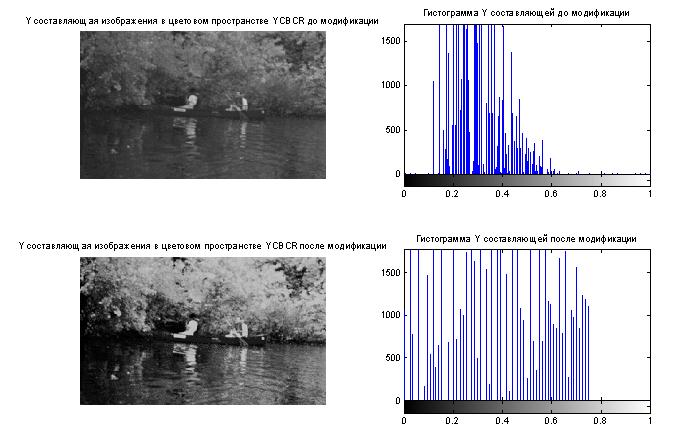

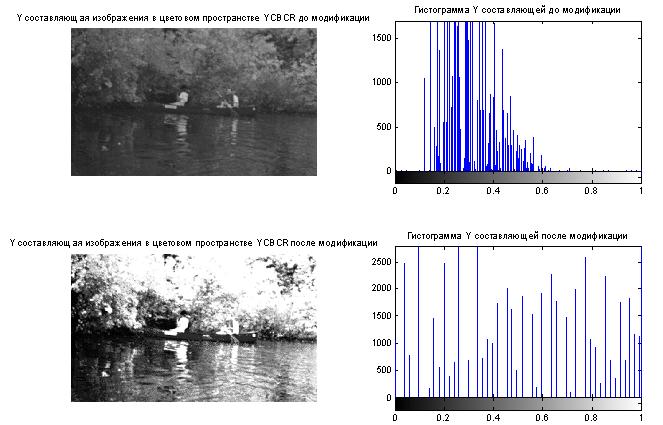

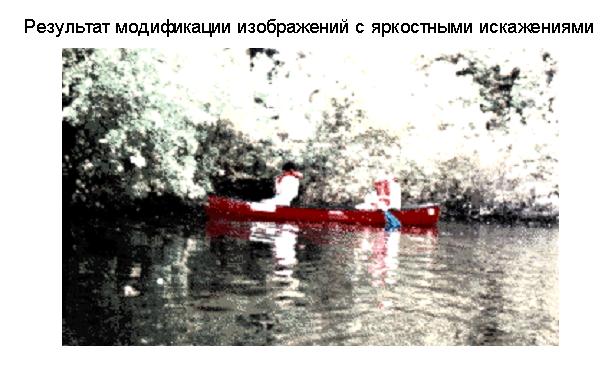

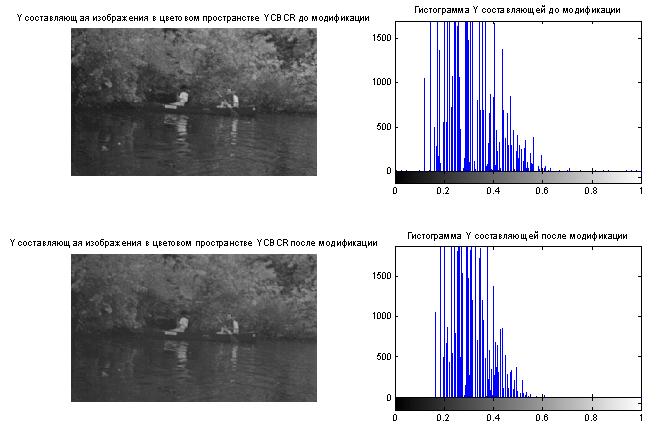

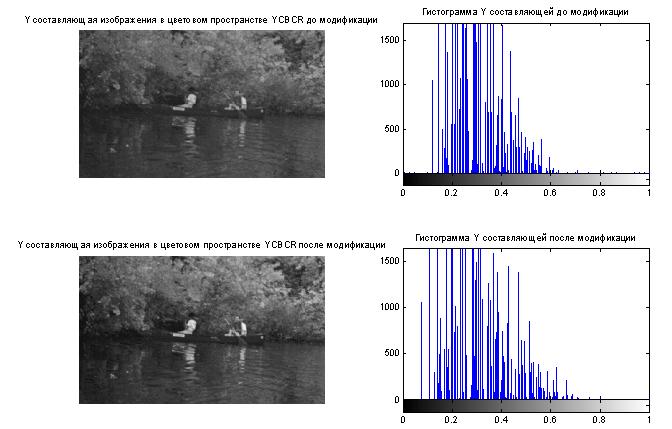

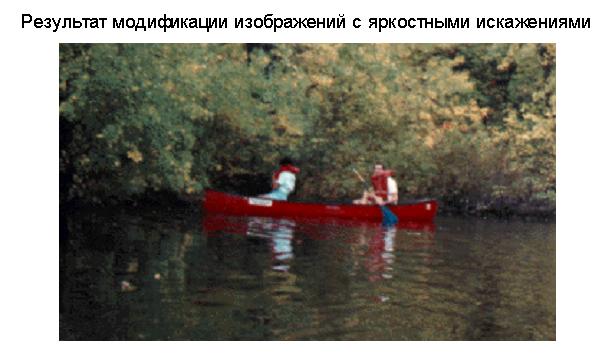

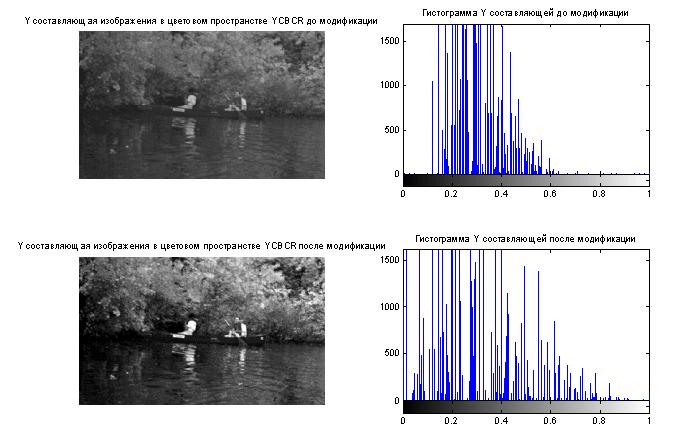

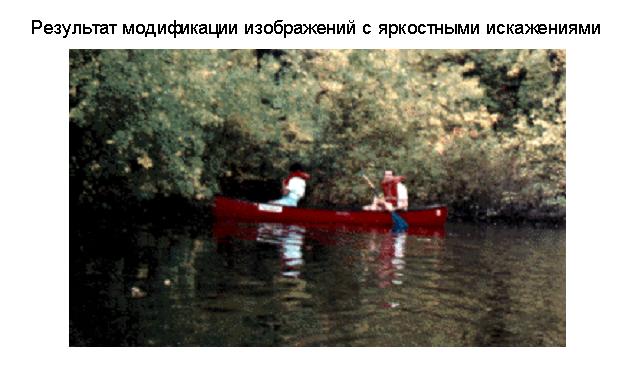

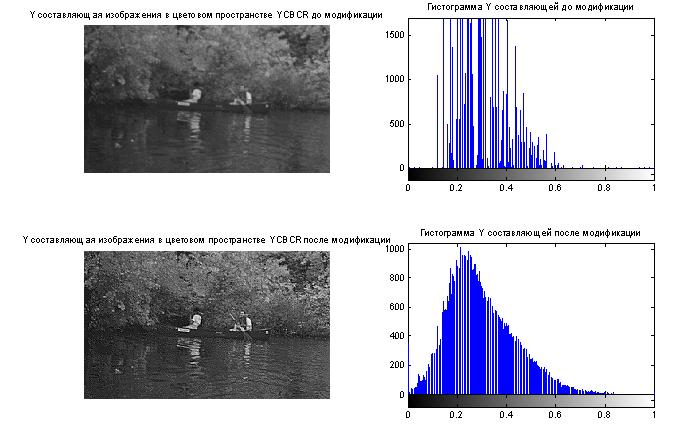

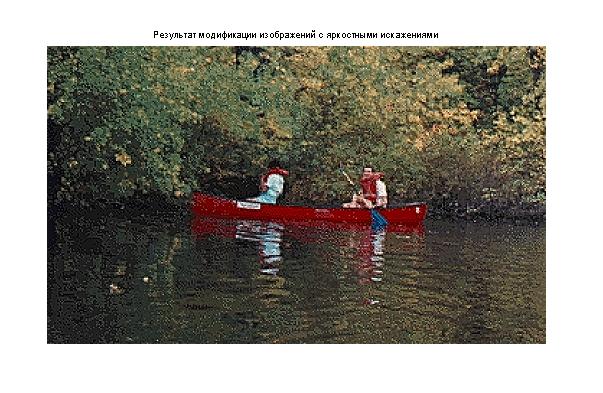

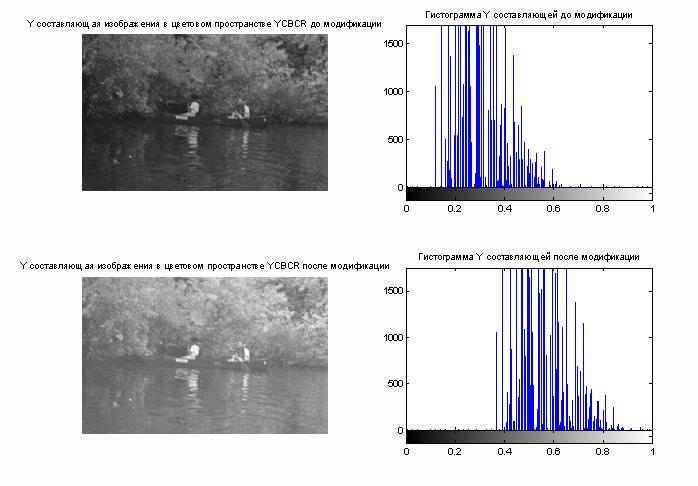

- Улучшение изображений с яркостными искажениями

- Некоторые алгоритмы повышения визуального качества изображений

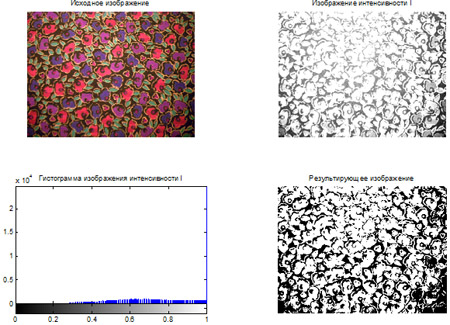

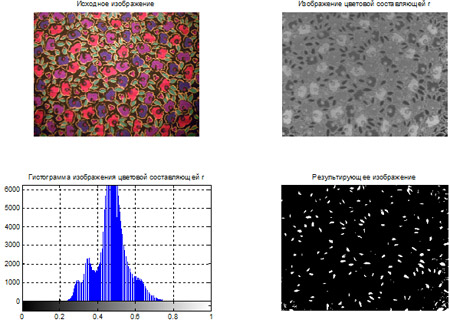

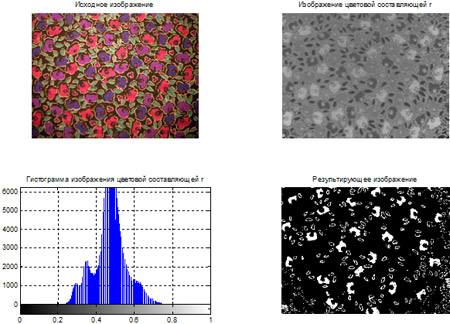

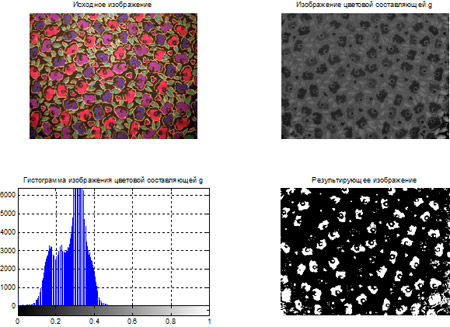

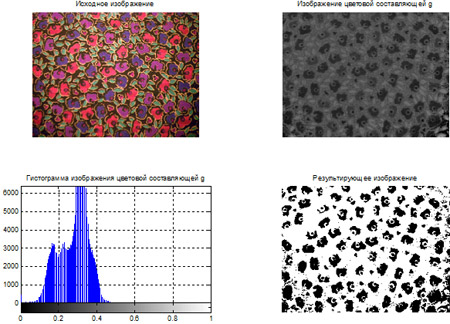

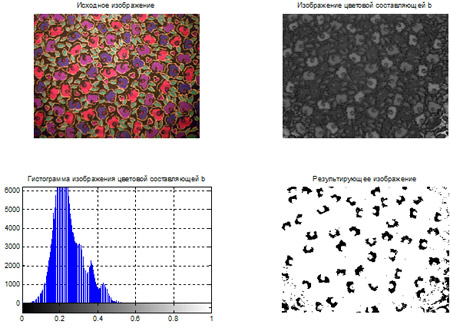

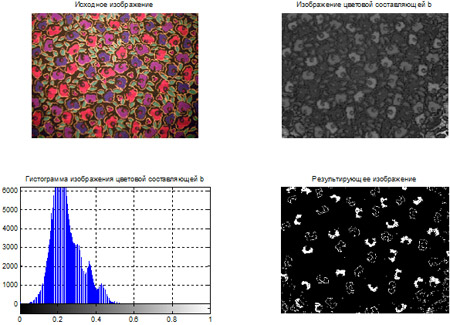

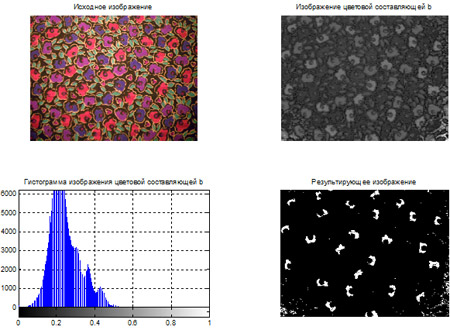

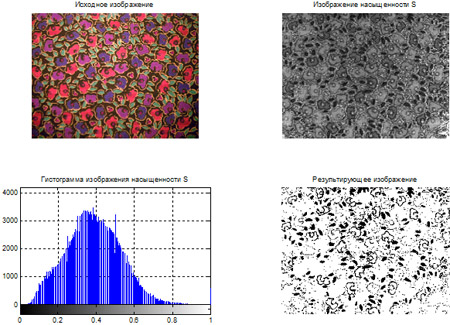

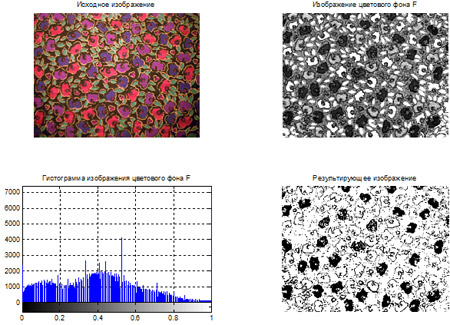

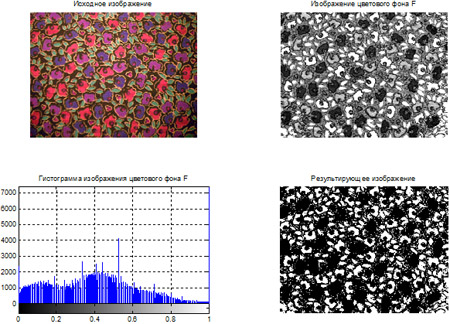

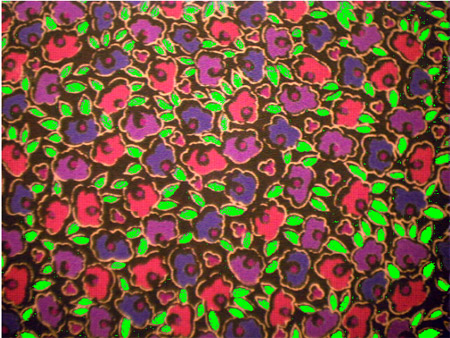

- Пороговая обработка цветных изображений

- Формирование ночного изображения на основе дневного и наоборот

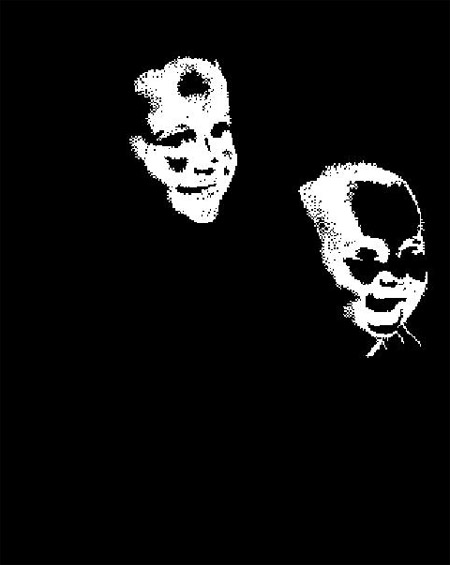

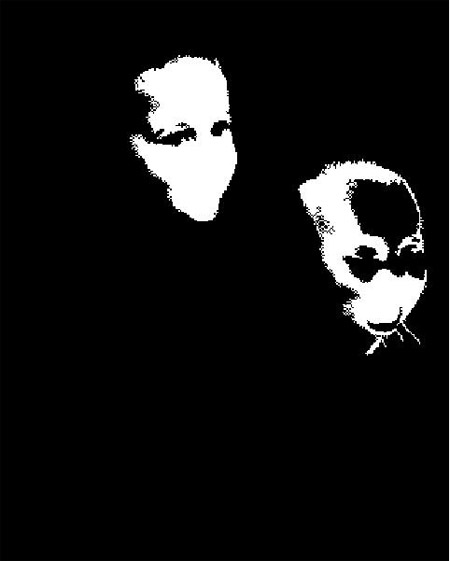

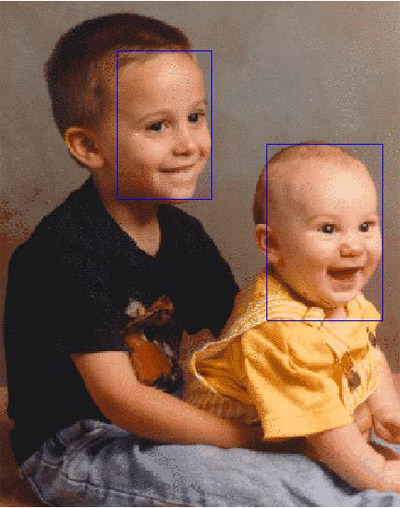

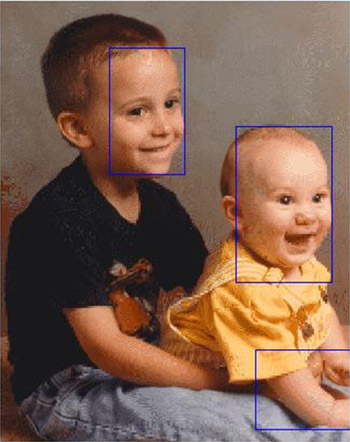

- Обнаружение лиц на основе цвета

- Метод управления яркостью изображения

Свойства зрительной системы человека

Большое количество информации представляется в виде статических или динамических изображений. Поскольку далее эти изображения рассматриваются и анализируются человеком, то важно знать механизмы зрительного восприятия. Эти знания являются мощным инструментом при разработке различных систем обработки изображений.

Отметим, что психофизические аспекты восприятия света изучены не полностью. Однако существует большое количество различных методов и подходов, объясняющих законы и свойства зрительного восприятия света человеком.

Глаз человека является уникальным механизмом, обеспечивающим адаптивную настройку в соответствии с внешними условиями.

Рассмотрим некоторые основные свойства зрительной системы человека. Важной характеристикой зрительной системы является чувствительность, т.е. способность реагировать на внешние изменения. Чувствительность характеризуется верхним и нижним абсолютными порогами.

Существует несколько различных видов чувствительности. Световая чувствительность характеризует свойство глаза реагировать на максимально малый световой поток. Однако здесь следует отметить, что вероятность распознавания максимально малого светового потока зависит также и от других факторов, например угла зрения.

Зрительная система по-разному реагирует на излучения, которые равны по мощности, но излучаемые из различных диапазонов спектра. Такая чувствительность называется спектральной.

Способность глаза различать минимальные различия яркости смежных областей изображения характеризуется контрастной чувствительностью. Также зрительная система характеризуется различной чувствительностью к цветовому тону, т.е. к излучениям из различных участков спектра. Зрительная система характеризуется еще чувствительностью к насыщенности цвета.

Приведенные выше типы чувствительности зрительной системы не являются постоянными, а зависят от многих факторов, в частности, условий освещения. Например, при переходе из темной комнаты в светлую, нужно некоторое время для восстановления светочувствительности глаза. Этот процесс называется яркостной адаптацией глаза.

Цветоощущение характеризуется тремя основными характеристиками – светлота, цветовой тон и насыщенность. Для классификации цветов используются цветовые пространства.

На основе свойств и характеристик зрительных систем создаются различные модели цветового зрения. Среди них следует выделить модель цветового зрения, предложенную Фреем. Особенностью этой модели является то, что зрительная система представлена тремя каналами, два из которых характеризуют цветность, а третий – яркость. Эта модель наиболее удачно согласуется со многими свойствами цветного зрения.

Возможности цифровой обработки изображений в Matlab

На сегодняшний день система Matlab, в частности пакет прикладных программ Image Processing Toolbox, является наиболее мощным инструментом для моделирования и исследования методов обработки изображений. Он включает большое количество встроенных функций, реализующих наиболее распространенные методы обработки изображений. Рассмотрим основные возможности пакета Image Processing Toolbox.

Геометрические преобразования изображений

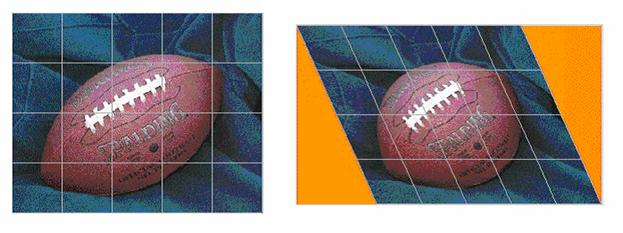

К наиболее распространенным функциям геометрических преобразований относится кадрирование изображений (imcrop), изменение размеров (imresize) и поворот изображения (imrotate).

Суть кадрирования состоит в том, что функция imcrop позволяет с помощью мыши в интерактивном режиме вырезать часть изображения и поместить ее в новое окно просмотра.

L=imread('cameraman.tif');

imshow(L);

imcrop;

Функция изменения размеров изображения imresize позволяет, используя специальные методы интерполяции, изменять размер любого типа изображения.

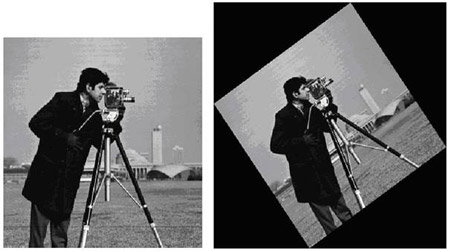

В пакете Image Processing Toolbox существует функция imrotate, которая осуществляет поворот изображения на заданный угол.

L1=imrotate(L,35,'bicubic'); figure,imshow(L1)

Таким образом, приведенные выше функции позволяют поворачивать, вырезать части, масштабировать, т.е. работать с целым массивом изображения.

Анализ изображений

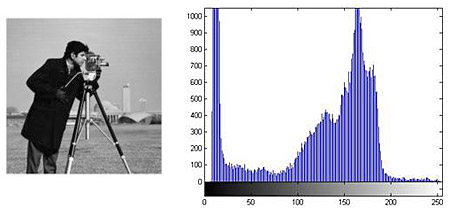

Для работы с отдельными элементами изображений используются такие функции как imhist, impixel, mean2, corr2 и другие.

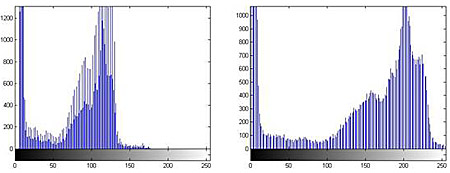

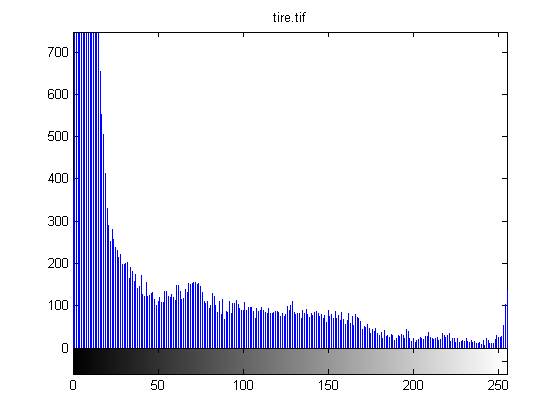

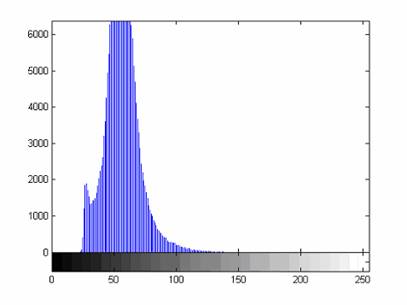

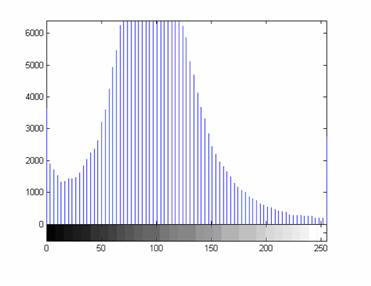

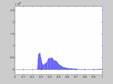

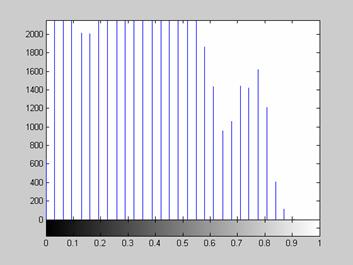

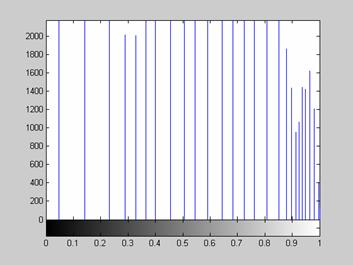

Одной из наиболее важных характеристик является гистограмма распределения значений интенсивностей пикселей изображения, которую можно построить с помощью функции imhist.

L=imread('cameraman.tif');

figure, imshow(L);

figure, imhist(L);

Довольно часто при проведении анализа изображений возникает необходимость определить значения интенсивностей некоторых пикселей. Для этого в интерактивном режиме можно использовать функцию impixel.

>> impixel

ans =

173 173 173

169 169 169

163 163 163

39 39 39

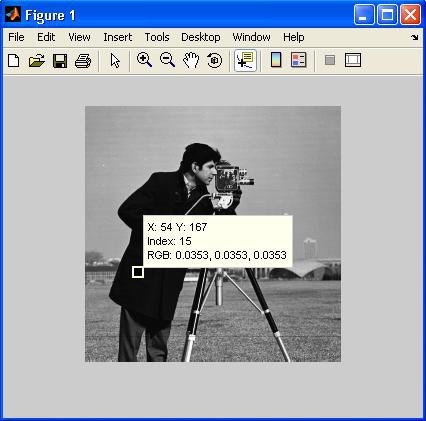

Следует отметить, что функция impixel по своим возможностям в некоторой степени повторяет опцию Data Cursor, пример использования которой при веден на изображении внизу.

Еще одной широко применяемой функцией является функция mean2 – она вычисляет среднее значение элементов матрицы.

Функция corr2 вычисляет коэффициент корреляции между двумя матрицами. Другими словами, с помощью функции corr2 можно сказать насколько две матрицы или изображения похожи между собой. Эта функция широко применяется при решении задач распознавания.

Улучшение изображений

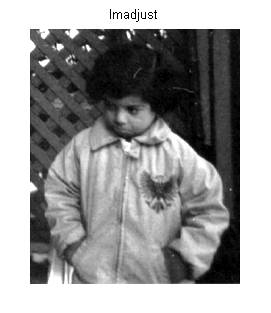

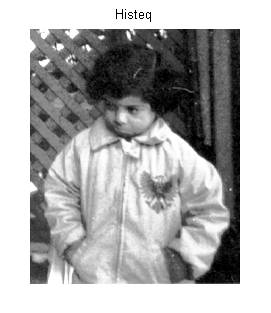

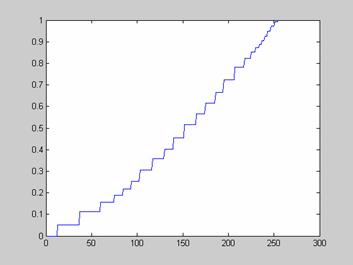

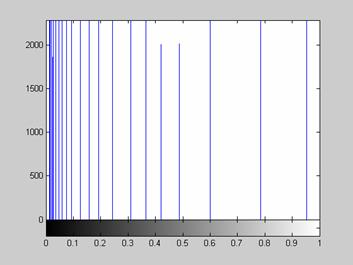

Среди встроенных функций, которые реализуют наиболее известные методы улучшения изображений, выделим следующие – histeq, imadjust та imfilter(fspecial).

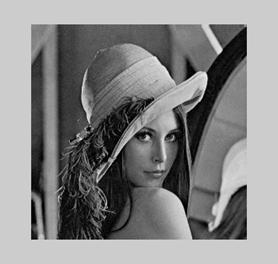

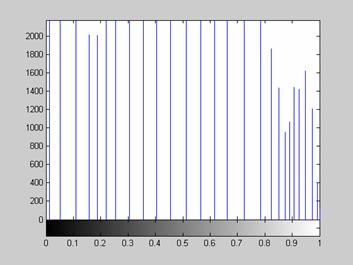

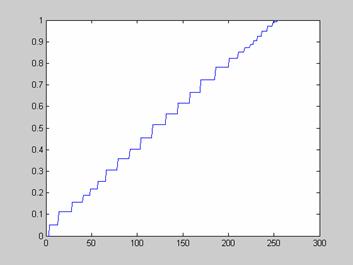

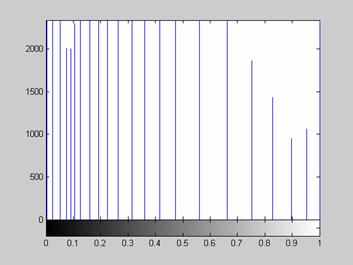

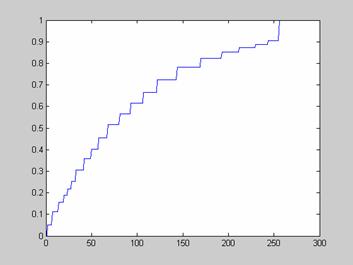

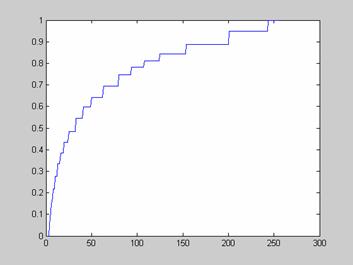

Как уже отмечалось ранее, гистограмма изображения является одной из наиболее информативных характеристик. На основе анализа гистограммы можно судить о яркостных искажениях изображения, т.е. сказать о том, является ли изображение затемненным или засветленным. Известно, что в идеале на цифровом изображении в равном количестве должны присутствовать пиксели со всеми значениями яркостей, т.е. гистограмма должна быть равномерной. Перераспределение яркостей пикселей на изображении с целью получения равномерной гистограммы выполняет метод эквализации, который в системе Matlab реализован в виде функции histeq.

L=imread('cameraman.tif');

figure, imshow(L);

L1=histeq(L);

Figure, imsow(L1);

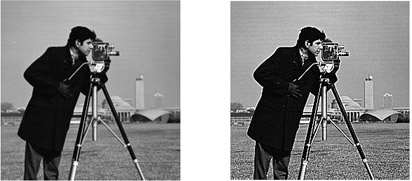

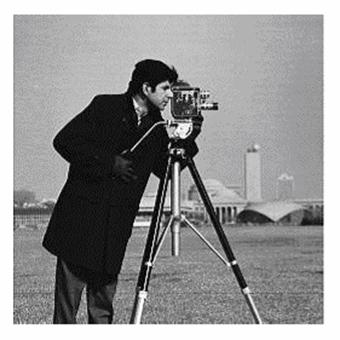

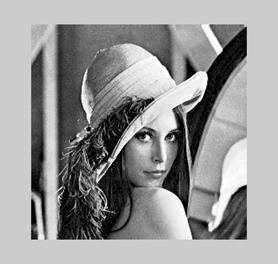

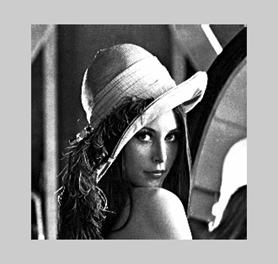

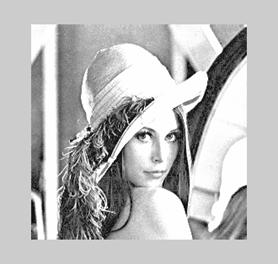

Исходное изображение

Изображение после эквализации гистограммы

Довольно часто при формировании изображений не используется весь диапазон значений интенсивностей, что отрицательно отражается на качестве визуальных данных. Для коррекции динамического диапазона сформированных изображений используется функция imadjust.

L=imread('cameraman.tif');

figure, imshow(L);

L1=imadjust(L);

figure, imshow(L1);

figure, imhist(L);

figure, imhist(L1);

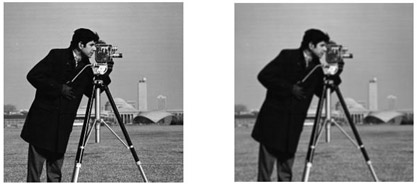

Также при решении задач улучшения изображений используется функция imfilter в паре с функцией fspecial. Функция fspecial позволяет задавать различные типы масок фильтра. Рассмотрим пример использования маски фильтра, повышающего резкость изображения.

L=imread('cameraman.tif');

figure, imshow(L);

H = fspecial('unsharp');

L1 = imfilter(L,H,'replicate');

figure, imshow(L1);

Фильтрация изображений

Пакет Image Processing Toolbox обладает очень мощным инструментарием по фильтрации изображений. Среди множества встроенных функций, которые решают задачи фильтрации изображений, особо следует выделить fspecial, ordfilt2, medfilt2.

Функция fspecial является функцией задания маски предопределенного фильтра. Эта функция позволяет формировать маски:

- высокочастотного фильтра Лапласа;

- фильтра, аналогичного последовательному применению фильтров Гаусса и Лапласа, так называемого лапласиана-гауссиана;

- усредняющего низкочастотного фильтра;

- фильтра, повышающего резкость изображения.

Рассмотрим примеры применения названных выше фильтров:

L=imread('cameraman.tif');

figure, imshow(L);

h=fspecial('laplasian',.5);

L1 = imfilter(L,h,'replicate');

figure, imshow(L1);

h=fspecial('log', 3, .5);

L1 = imfilter(L,h,'replicate');

figure, imshow(L1);

h=fspecial('average', 3);

L1 = imfilter(L,h,'replicate');

figure, imshow(L1);

h=fspecial('unsharp', .5);

L1 = imfilter(L,h,'replicate');

figure, imshow(L1);

Сегментация изображений

Среди встроенных функций пакета Image Processing Toolbox, которые применяются при решении задач сегментации изображений, следует выделить qtdecomp, edge и roicolor.

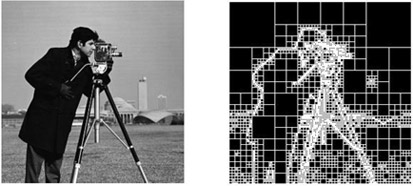

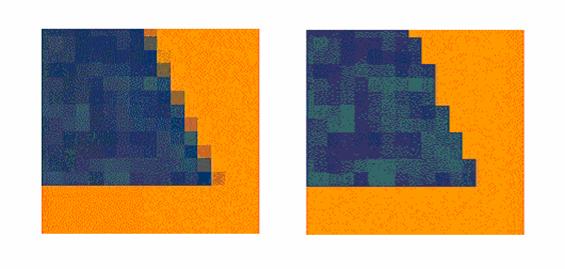

Функция qtdecomp выполняет сегментацию изображения методом разделения и анализа однородности не перекрывающихся блоков изображения.

I = imread('cameraman.tif');

S = qtdecomp(I,.27);

blocks = repmat(uint8(0),size(S));

for dim = [512 256 128 64 32 16 8 4 2 1];

numblocks = length(find(S==dim));

if (numblocks > 0)

values = repmat(uint8(1),[dim dim numblocks]);

values(2:dim,2:dim,:) = 0;

blocks = qtsetblk(blocks,S,dim,values);

end

end

blocks(end,1:end) = 1;

blocks(1:end,end) = 1;

imshow(I), figure, imshow(blocks,[])

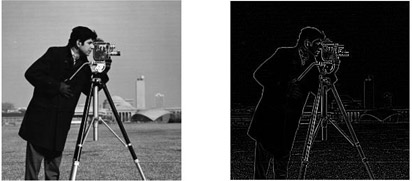

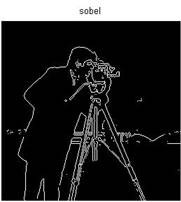

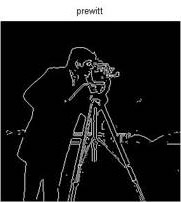

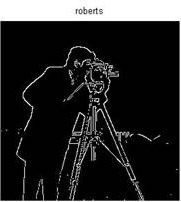

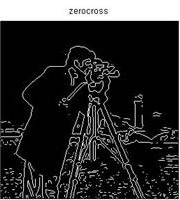

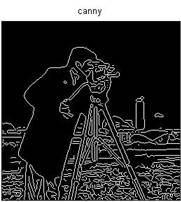

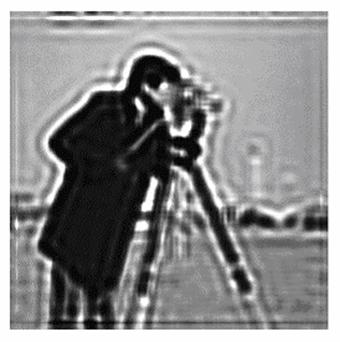

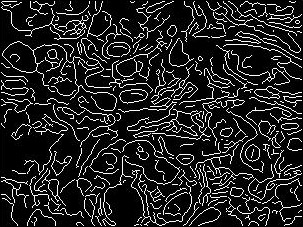

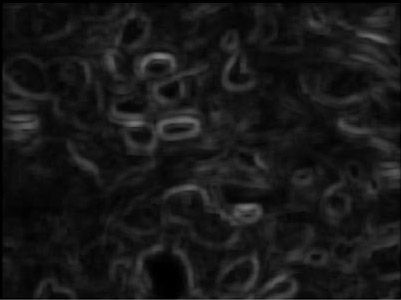

Одной из наиболее часто применяемых является функция выделения границ edge, которая реализует такие встроенные методы – Собела, Превит, Робертса, лапласиан-гауссиана, Канни и др.

Приведем примеры реализации функции edge с использованием различных фильтров.

clear;

I = imread('cameraman.tif');

BW1=edge(I,'sobel');

figure,imshow(BW1);title('sobel');

BW2=edge(I,'prewitt');

figure,imshow(BW2);title('prewitt');

BW3=edge(I,'roberts');

figure,imshow(BW3);title('roberts');

BW4=edge(I,'log');

figure,imshow(BW4);title('log');

BW5=edge(I,'zerocross');

figure,imshow(BW5);title('zerocross');

BW6=edge(I,'canny');

figure,imshow(BW6);title('canny');

|

|

|

|

|

|

Еще одной функцией, которая применяется для бинаризации по заданным цветам, является функция roicolor. Приведем пример ее использования.

I = imread('cameraman.tif');

figure, imshow(I);

BW = roicolor(I,128,255);

imshow(I);

figure, imshow(BW);

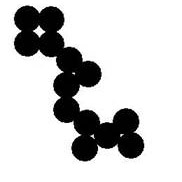

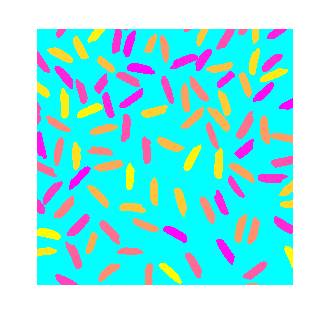

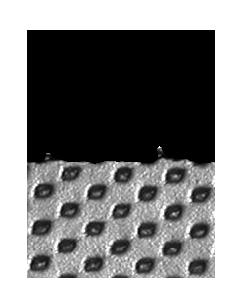

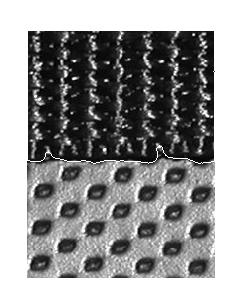

Морфологические операции над бинарными изображениями

Система Matlab владеет довольно мощным инструментарием морфологической обработки бинарных изображений. Среди основных операций выделим следующие – эрозия, наращивание, открытие, закрытие, удаление изолированных пикселей, построение скелета изображения и т.п.

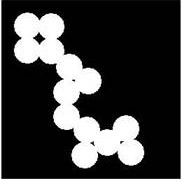

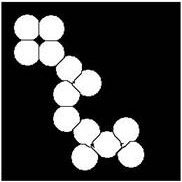

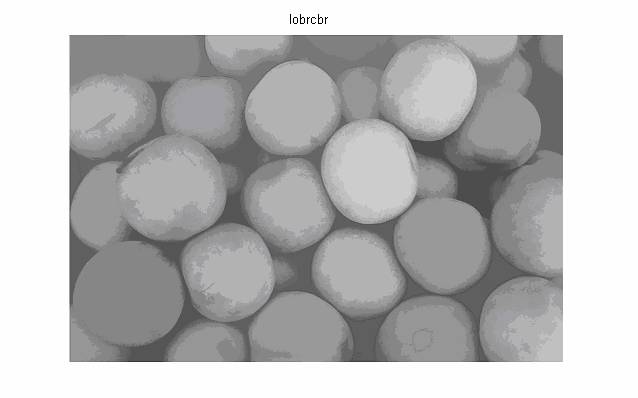

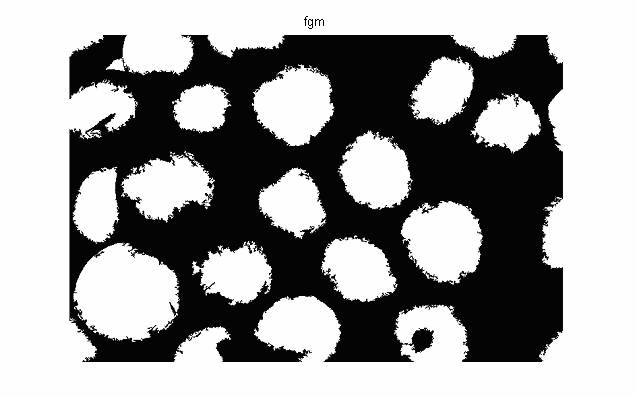

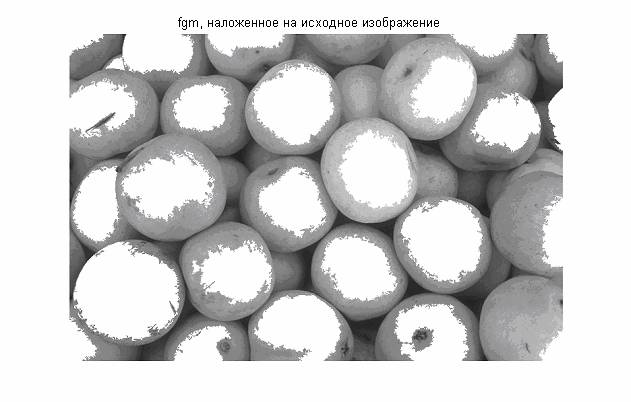

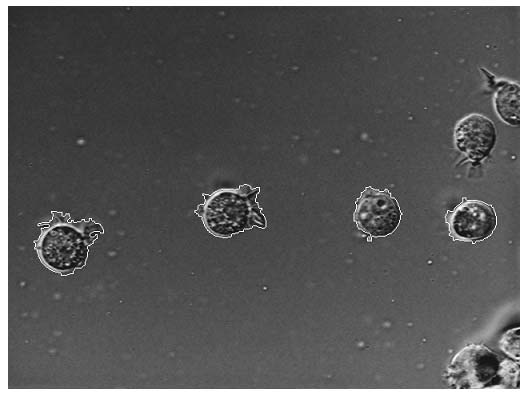

В качестве примера приведем решение задачи разделения слипшихся объектов с помощью морфологических операций.

clear;

L=imread('circles.bmp');

L=L(:,:,1);

imshow(L);

BW1=L<150;

figure,imshow(BW1);

BW2=bwmorph(BW1,'erode',12);

figure,imshow(BW2);

BW2=bwmorph(BW2,'thicken',Inf);

figure,imshow(BW2);

BW1=BW1&BW2;

figure,imshow(BW1);

Исходное изображение

Бинарное изображение |

Эрозия бинарного изображения |

Утолщение объектов |

Результат разделения слипшихся объектов |

Кроме перечисленных возможностей, пакет прикладных программ Image Processing Toolbox владеет широкими возможностями при решении задач анализа изображений, в частности, при поиске объектов и вычислении их признаков.

Из представленного материала видно, что пакет прикладных программ Image Processing Toolbox обладает мощным инструментарием для обработки и анализа цифровых изображений. Это приложение является очень удобной средой для разработки и моделирования различных методов. Возможности каждой из приведенных выше, а также других, функций будут детально рассмотрены в последующих материалах.

Типы изображений

Интегрированные среды для моделирования и исполнения программ цифровой обработки изображений и сигналов содержат мощные средства для инженерно–научных расчетов и визуализации данных. Большинство современных пакетов поддерживает визуальное программирование на основе блок–схем. Это позволяет создавать программы специалистам, не владеющим техникой программирования. К таким пакетам относится Image Processing Toolbox системы MATLAB, разработанный фирмой MathWorks. Этот пакет владеет мощными средствами для обработки изображений. Они имеют открытую архитектуру и позволяют организовывать взаимодействие с аппаратурой цифровой обработки сигналов, а также подключать стандартные драйвера.

Система MATLAB и пакет прикладных програм Image Processing Toolbox (IPT) является хорошим инструментом разработки, исследования и моделирования методов и алгоритмов обработки изображений. При решении задач обработки изображений пакет IPT позволяет идти двумя путями. Первый из них состоит в самостоятельной программной реализации методов и алгоритмов. Другой путь позволяет моделировать решение задачи с помощью готовых функций, которые реализуют наиболее известные методы и алгоритмы обработки изображений. И тот, и другой способ оправдан. Но все же для исследователей и разработчиков методов и алгоритмов обработки изображений предпочтительным является второй путь.

Это объясняется гибкостью таких программ, возможностью изменения всех параметров, что очень актуально при исследовании, разработке, определении параметром регуляризации и т.д. Прежде чем использовать для решения каких-либо задач обработки изображений стандартные функции пакета IPT, разработчик должен в совершенстве их исследовать. Для этого он должен точно знать, какой метод и с какими параметрами реализует та или иная функция.

В том и другом подходе к решению задачи обработки видеоданных объектом исследования является изображение. Для этого рассмотрим коротко особенности представления изображений в IPT.

Изображения бывают векторными и растровыми. Векторным называется изображение, описанное в виде набора графических примитивов. Растровые же изображения представляют собой двумерный массив, элементы которого (пикселы) содержат информацию о цвете. В цифровой обработке используются растровые изображения. Они в свою очередь делятся на типы - бинарные, полутоновые, палитровые, полноцветные.

Элементы бинарного изображения могут принимать только два значения - 0 или 1. Природа происхождения таких изображений может быть самой разнообразной. Но в большинстве случаев, они получаются в результате обработки полутоновых, палитровых или полноцветных изображений методами бинаризации с фиксированным или адаптивным порогом. Бинарные изображения имеют то преимущество, что они очень удобны при передаче данных.

Полутоновое

изображение состоит из элементов, которые могут принимать одно из значений интенсивности какого-либо одного цвета. Это один из наиболее распространенных типов изображений, который применяется при различного рода исследованиях. В большинстве случаев используется глубина цвета 8 бит на элемент изображения.

В палитровых

изображениях значение пикселов является ссылкой на ячейку карты цветов (палитру). Палитра представляет собой двумерный массив, в столбцах которого расположены интенсивности цветовых составляющих одного цвета.

В отличии от палитровых, элементы полноцветных изображений непосредственно хранят информацию о яркостях цветовых составляющих.

Выбор типа изображения зависит от решаемой задачи, от того, насколько полно и без потерь нужная информация может быть представлена с заданной глубиной цвета. Также следует учесть, что использование полноцветных изображений требует больших вычислительных затрат.

В зависимости от типа изображения они по-разному представляются в разных форматах. Этот момент будет очень важным при создании программ в среде IPT. Наиболее удобно зависимость способов представления элементов изображения (диапазон их значений) от типа и формата представить в виде таблицы.

| Тип изображения | double | uint8 |

| Бинарное | 0 и 1 | 0 и 1 |

| Полутоновое | [0, 1] | [0, 255] |

| Палитровое | [1, размер палитры],

где 1 - первая строка палитры |

[0, 255],

где 0 - первая строка палитры.* |

| Полноцветное | [0, 1] | [0, 255] |

*

Примечание. При программной реализации лучше избегать использования такой индексации строк. MATLAB корректно воспринимает индексацию с первой, а не нулевой строки.

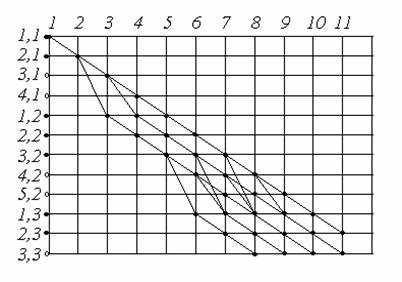

В дальнейшем, при рассмотрении методов обработки изображений, будем считать, что изображение представляется матрицей чисел (размер матрицы ), где значение каждого элемента отвечает определенному уровню квантования его энергетической характеристики (яркости). Это так называемая пиксельная система координат. Она применяется в большинстве функций пакета IPT. Существует также пространственная система координат, где изображение представляется непрерывным числовым полем квадратов с единичной величиной. Количество квадратов совпадает с числом пикселов. Значение интенсивности элемента в центре квадрата совпадает со значением соответствующего пиксела в пиксельной системе координат. При решении практических задач, связанных с измерениями реальных геометрических размеров объектов на изображении, удобно использовать пространственную систему координат, так как она позволяет учитывать разрешение (количество пикселов на метр) системы.

), где значение каждого элемента отвечает определенному уровню квантования его энергетической характеристики (яркости). Это так называемая пиксельная система координат. Она применяется в большинстве функций пакета IPT. Существует также пространственная система координат, где изображение представляется непрерывным числовым полем квадратов с единичной величиной. Количество квадратов совпадает с числом пикселов. Значение интенсивности элемента в центре квадрата совпадает со значением соответствующего пиксела в пиксельной системе координат. При решении практических задач, связанных с измерениями реальных геометрических размеров объектов на изображении, удобно использовать пространственную систему координат, так как она позволяет учитывать разрешение (количество пикселов на метр) системы.

Маска фильтра (или скользящее окно, или апертура) представляет собой матрицу размера  . Она накладывается на изображение и осуществляется умножением элементов маски фильтра и соответствующих элементов изображения с последующей обработкой результата. Когда маска передвигается к границе изображения, возникает так называемое явление краевого эффекта. Во избежание этого нежелательного эффекта необходимо, когда маска вышла за пределы исходного изображения, дополнить его не нулевыми элементами (как советует большинство книг по Matlab), а элементами изображения, симметричными относительно его краев.

. Она накладывается на изображение и осуществляется умножением элементов маски фильтра и соответствующих элементов изображения с последующей обработкой результата. Когда маска передвигается к границе изображения, возникает так называемое явление краевого эффекта. Во избежание этого нежелательного эффекта необходимо, когда маска вышла за пределы исходного изображения, дополнить его не нулевыми элементами (как советует большинство книг по Matlab), а элементами изображения, симметричными относительно его краев.

Обработка изображений осуществляется рекурсивными и нерекурсивными методами. Рекурсивные методы используют результат обработки предыдущего пиксела, нерекурсивные - не используют. В большинстве случаев используются нерекурсивные алгоритмы обработки изображений.

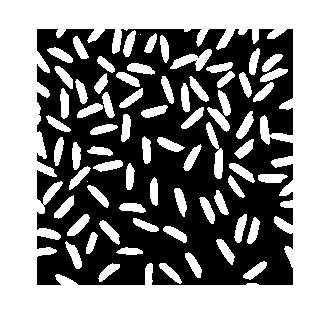

Бинарные изображения: геометрические характеристики

В этой работе рассматриваются черно–белые (бинарные) изображения [1]. Их легче получать, хранить и обрабатывать, чем изображения, в которых имеется много уровней яркости. Однако, поскольку в бинарных изображениях кодируется информация лишь о силуэте объекта, область их применения ограничена. В дальнейшем будут сформулированы условия, необходимые для успешного использования методов обработки бинарных изображений. Здесь же внимание акцентируется на таких простых геометрических характеристиках изображений, как площадь объекта, его положение и ориентация. Подобные величины могут использоваться, например, в процессе управления механическим манипулятором при его работе с деталями.

Поскольку изображения содержат большой объем информации, важную роль начинают играть вопросы ее представления. Покажем, что интересующие нас геометрические характеристики можно извлечь из проекций бинарных изображений. Проекции гораздо легче хранить и обрабатывать. Также рассмотрим непрерывные бинарные изображения, характеристическая функция которых равна нулю или единице в каждой точке плоскости изображения. Это упрощает анализ, однако при использовании ЭВМ изображение необходимо разбить на дискретные элементы.

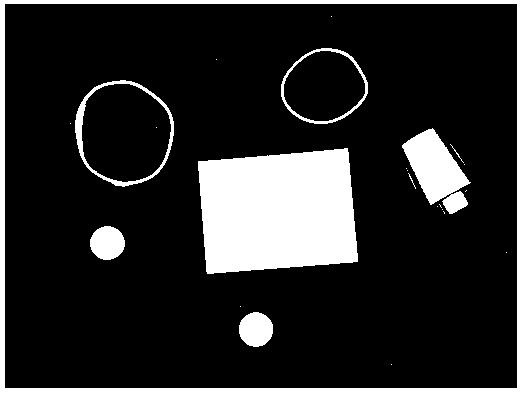

Бинарные изображения

Начнем со случая, когда в поле зрения находится объект, а все остальное считается “фоном”. Если объект оказывается заметно темнее (или светлее), чем фон, то легко определить характеристическую функцию ![]() , которая равна нулю для всех точек изображения, соответствующих фону, и единице для точек на объекте (рис.1) или наоборот.

, которая равна нулю для всех точек изображения, соответствующих фону, и единице для точек на объекте (рис.1) или наоборот.

Рис. 1. Бинарное изображение, определяемое характеристической функцией ![]() , которая принимает значение “нуль” и “единица”.

, которая принимает значение “нуль” и “единица”.

Часто бинарное изображение получают пороговым разделением обычного изображения. К нему также можно прийти путем порогового разделения расстояния на “изображении”, полученном на основе измерений расстояний.

Такую функцию, принимающую два значения и называемую бинарным изображением, можно получить пороговым разделением полутонового изображения. Операция порогового разделения заключается в том, что характеристическая функция полагается равной нулю в точках, где яркость больше некоторого порогового значения, и единице, где она не превосходит его (или наоборот).

Иногда бывает удобно компоненты изображения, а также отверстия в них рассматривать как множества точек. Это позволяет комбинировать изображения с помощью теоретико–множественных операций, например, объединение и пересечение. В других случаях удобно поточечно использовать булевые операции. На самом деле это лишь два различных способа описания одних и тех же действий над изображениями.

Поскольку количество информации, содержащиеся в бинарном изображении, на порядок меньше, чем в совпадающем с ним по размерам полутоновом изображении, бинарное изображение легче обрабатывать, хранить и пересылать. Естественно, определенная часть информации при переходе к бинарным изображениям теряется, и, кроме того, сужается круг методов обработки таких изображений. В настоящее время существует достаточно полная теория того, что можно и чего нельзя делать с бинарными изображениями, чего, к сожалению, нельзя сказать о полутоновых изображениях.

Прежде всего мы можем вычислить различные геометрические характеристики изображения, например, размер и положение объекта. Если в поле зрения находится более одного объекта, то можно определить топологические характеристики имеющейся совокупности объектов: например, разность между числом объектов и числом отверстий (число Эйлера).

Пример:

Этой операции соответствует функция BWEULER – вычисление чисел Эйлера в пакете Image Processing Toolbox:

L=imread('test.bmp');

L=double(L);

imshow(L);

e=bweuler(L(:,:,1), 4)

e =

1; % На объекте действительно одно отверстие.

Нетрудно также пометить отдельные объекты и вычислить геометрические характеристики для каждого из них в отдельности. Наконец, перед дальнейшей обработкой изображение можно упростить, постепенно модифицируя его итеративным образом.

Обработка бинарных изображений хорошо понятна, и ее нетрудно приспособить под быструю аппаратную реализацию, но при этом нужно помнить об ограничениях. Мы уже упоминали о необходимости высокой степени контраста между объектом и фоном. Кроме того, интересующий нас образ должен быть существенно двумерным. Ведь все, чем мы располагаем, — лишь очертания или силуэт объекта. По такой информации трудно судить о его форме или пространственном положении.

Характеристическая функция ![]() определена в каждой точке изображения. Такое изображение будем называть непрерывным. Позже мы рассмотрим дискретные бинарные изображения, получаемые путем подходящего разбиения поля изображения на элементы.

определена в каждой точке изображения. Такое изображение будем называть непрерывным. Позже мы рассмотрим дискретные бинарные изображения, получаемые путем подходящего разбиения поля изображения на элементы.

Простые геометрические характеристики

Допустим снова, что в поле зрения находится лишь один объект. Если известна характеристическая функция ![]() , то площадь объекта вычисляется следующим образом:

, то площадь объекта вычисляется следующим образом:

![]() ,

,

где интегрирование осуществляется по всему изображению I. При наличии более одного объекта эта формула дает возможность определить их суммарную площадь.

Пример:

В системе Matlab этой операции соответствует функция BWAREA – вычисление площади объектов.

L=imread('test.bmp');

L=double(L);

imshow(L);

S=bwarea(L(:,:,1))

e =

24926; %Площадь объекта в пикселах (размер изображения 236х236).

Площадь и положение

Как определить положение объекта на изображении? Поскольку объект, как правило, состоит не из одной единственной точки, мы должны четко определить смысл термина “положение”. Обычно в качестве характерной точки объекта выбирают его геометрический центр (рис. 2).

Рис. 2. Положение области на бинарном изображении, которое можно определить ее геометрическим центром. Последний представляет собой центр масс тонкого листа материала той же формы.

Геометрический центр — это центр масс однородной фигуры той же формы. В свою очередь центр масс определяется точкой, в которой можно сконцентрировать всю массу объекта без изменения его первого момента относительно любой оси. В двумерном случае первый момент относительно оси ![]() рассчитывается по формуле

рассчитывается по формуле

![]() ,

,

а относительно оси ![]() — по формуле

— по формуле

![]() ,

,

где ![]() — координаты геометрического центра. Интегралы в левой части приведенных соотношений — не что иное, как площадь

— координаты геометрического центра. Интегралы в левой части приведенных соотношений — не что иное, как площадь![]() , о которой речь шла выше. Чтобы найти величины

, о которой речь шла выше. Чтобы найти величины ![]() и

и ![]() , необходимо предположить, что величина

, необходимо предположить, что величина ![]() не равна нулю. Заметим попутно, что величина

не равна нулю. Заметим попутно, что величина ![]() представляет собой момент нулевого порядка функции

представляет собой момент нулевого порядка функции ![]() .

.

Ориентация

Мы также хотим определить, как расположен объект в поле зрения, т. е. его ориентацию. Сделать это несколько сложнее. Допустим, что объект немного вытянут вдоль некоторой оси; тогда ее ориентацию можно принять за ориентацию объекта. Как точно определить ось, вдоль которой вытянут объект? Обычно выбирают ось минимального второго момента. Она представляет собой двумерный аналог оси наименьшей инерции. Нам необходимо найти прямую, для которой интеграл от квадратов расстояний до точек объекта минимален; этот интеграл имеет вид

![]() ,

,

где ![]() — расстояние вдоль перпендикуляра от точки с координатами

— расстояние вдоль перпендикуляра от точки с координатами ![]() до искомой прямой.

до искомой прямой.

Иной путь решения проблемы состоит в попытке найти угол поворота ![]() , при котором матрица вторых моментов размера 2x2 имеет диагональный вид.

, при котором матрица вторых моментов размера 2x2 имеет диагональный вид.

(В пакете Matlab операции определения центра масс, ориентации а также другие морфометрические признаки вычисляются с помощью функции IMFEATURE.)

Проекции

Для вычисления положения и ориентации объекта достаточно знать первые и вторые моменты. (При этом остается двузначность в выборе направления на оси.) Чтобы найти их значения, нет необходимости в исходном изображении: достаточно знать его проекции. Указанный факт представляет интерес, поскольку проекции описываются более компактно и приводят к гораздо более быстрым алгоритмам.

Дискретные бинарные изображения

До сих пор мы рассматривали непрерывные бинарные изображения, определенные во всех точках плоскости. Должно быть очевидным, что при переходе к дискретным изображениям интегралы становятся суммами. Например, площадь вычисляется (в единицах площади элемента изображения) в виде суммы

![]() ,

,

где ![]() — значение бинарного изображения в точке, находящейся в

— значение бинарного изображения в точке, находящейся в ![]() –й строке и

–й строке и ![]() –м столбце. Здесь мы полагали, что поле изображения разбито на квадратную решетку с т столбцами и п строками.

–м столбце. Здесь мы полагали, что поле изображения разбито на квадратную решетку с т столбцами и п строками.

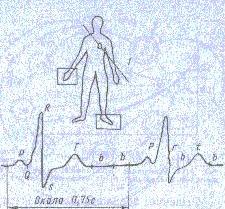

Часто изображение просматривается строка за строкой в той же самой последовательности, в какой телевизионный луч бежит по экрану (если не учитывать того, что четные строки считываются вслед за нечетными). Как только считано значение очередного элемента изображения, проверяем равенство ![]() . Если оно выполняется, добавляем 1,

. Если оно выполняется, добавляем 1, ![]() ,

, ![]() ,

, ![]() ,

, ![]() и

и ![]() к накапливаемым значениям площади, первых моментов и вторых моментов. По окончании цикла сканирования с помощью этих значений легко найти площадь, положение и ориентацию.

к накапливаемым значениям площади, первых моментов и вторых моментов. По окончании цикла сканирования с помощью этих значений легко найти площадь, положение и ориентацию.

Кодирование с переменной длиной

Существует несколько способов кодирования, позволяющих еще больше сжать информацию о бинарных изображениях. Одним из широко распространенных является кодирование с переменной длиной кодовой последовательности. Этот метод основан на том, что вдоль любой просматриваемой в данный момент строки обычно обнаруживаются длинные цепочки нулей и единиц. Поэтому вместо передачи отдельных битов информации мы можем посылать длины подобных цепочек. Код с переменной длиной есть просто ![]() .

.

|

0 |

1 |

1 |

1 |

1 |

0 |

0 |

0 |

1 |

1 |

0 |

0 |

0 |

0 |

Для обозначения начала каждой строки нужно ввести специальный признак. Кроме того, принимается соглашение относительно того, с чего начинается строка (с нуля или единицы). Если строка начинается с противоположного символа, то первым символом кода устанавливается нуль.

Другой подход к обработке изображений описан в книге [2]. Книга [3] содержит сведения о некоторых работах в области обработки бинарных изображений. Много интересных бинарных изображений, полученных художниками, можно найти в книге [4].

Кодирование с переменной длиной кодовой последовательности основывается на избыточности лишь в одном измерении. В целях уменьшения затрат на передачу и хранение данных было предпринято несколько попыток использовать пространственную взаимосвязь между элементами изображения в обоих направлениях. Быть может наиболее удачной среди схем такого рода является схема, разработанная фирмой IBM и описанная в отчете [5].

В системе Matlab также рассматривается один из видов кодирования, который содержится в описании функции BWPACK.

Литература

- Хорн Б.К.П. Зрение роботов: Пер. с англ. – М.: Мир, 1989. – 487 с., ил. ISBN 5–03–000570–6.

- Rosenfeld A., Kak A.C., Digital Picture Processing, Vols. 1, 2, Second Edition, Academic Press, New York, 1982.

- Stoffel J.C. (ed.), Graphical and Binary Image Processing and Applications, Artech House, Inc., Massachusetts, 1982.

- Grafton C.B. (ed.), Silhouettes – A Pictorial Archive of Varied Illustrations, Dover Publications, New York, 1979.

- Mitchell J.L., Goertzel G., Two–Dimensional Facsimile Coding Scheme, IBM Reserch Report RC 7499, Jan., 1979.

Бинарные изображения: топологические характеристики

Рассмотрим некоторые методы восстановления информации по бинарным изображениям. Для этого необходимо тщательно определить, что подразумевается под связностью двух элементов изображения. Нужно изучить этот вопрос для различных способов разбиения плоскости изображения и исследовать средства, позволяющие помечать различные компоненты изображения при последовательном его просмотре.

Изображения содержат большой объем информации. Один из путей ее обработки за приемлемое время состоит в широком использовании распараллеливания процессов. Существуют два изящных класса методов параллельной обработки бинарных изображений – локальные методы и методы итеративной модификации. Для понимания того, какие величины можно вычислить в результате их применения, вводится свойство аддитивности.

Приведенные здесь методы могут найти применение в задачах визуальной инспекции, обнаружения и распознавания объектов.

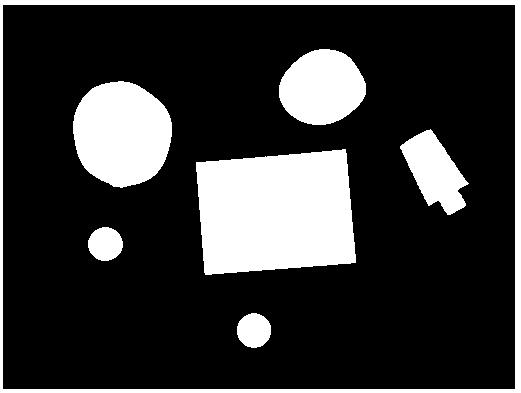

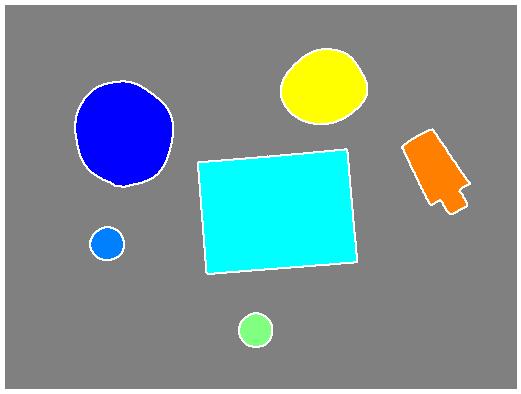

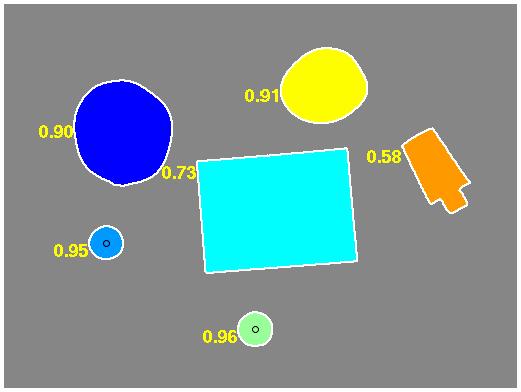

Сложные объекты

Иногда в поле зрения попадает более одного объекта (рис. 1). В этом случае вычисление площади, геометрического центра и ориентации приведет к значениям, “усредненным” по всем компонентам бинарного изображения. Как правило, это не то, что требуется. Желательно как-то пометить отдельные компоненты изображения и вычислить значения площади, первых и вторых моментов для каждой компоненты в отдельности.

Разметка компонент

Будем считать две точки изображения связанными, если существует путь между ними, вдоль которого характеристическая функция постоянна. Так, на рис. 1 точка А связана с точкой В, но не связана с точкой С. Связная компонента бинарного изображения есть максимальное множество связанных точек, т. е. множество, состоящее из всех тех точек, между любыми двумя из которых существует связывающий их путь.

Рис. 1. Изображение, состоящее из нескольких областей, для каждой из которых необходимо проводить расчет положения и ориентации.

Элементы изображения необходимо пометить таким образом, чтобы принадлежащие одной области были отличимы от остальных Для этого нам необходимо решить, какие точки принадлежат одной и той же области. На рисунке 1 точка А считается связанной с точкой В, поскольку мы можем найти непрерывную кривую, целиком лежащую в затененной области и соединяющую указанные точки. Ясно, что точка А не связана с точкой С, так как в этом случае подобной кривой найти нельзя.

Один из способов разметки объектов на дискретном бинарном изображении состоит в выборе произвольной точки, в которой ![]() , и приписывании метки этой точке и ее соседям. На следующем шаге помечаются соседи этих соседей (кроме уже помеченных) и т. д. По завершении этой рекурсивной процедуры одна компонента будет полностью помечена, и процесс можно будет продолжить, выбрав новую начальную точку. Чтобы ее отыскать, достаточно каким-либо систематическим образом перемещаться по изображению до тех пор, пока не встретится первая еще непомеченная точка, в которой

, и приписывании метки этой точке и ее соседям. На следующем шаге помечаются соседи этих соседей (кроме уже помеченных) и т. д. По завершении этой рекурсивной процедуры одна компонента будет полностью помечена, и процесс можно будет продолжить, выбрав новую начальную точку. Чтобы ее отыскать, достаточно каким-либо систематическим образом перемещаться по изображению до тех пор, пока не встретится первая еще непомеченная точка, в которой ![]() . Когда на этом этапе не останется ни одного такого элемента, все объекты изображения окажутся размеченными.

. Когда на этом этапе не останется ни одного такого элемента, все объекты изображения окажутся размеченными.

Ясно, что “фон” также можно разбить на связные компоненты, поскольку объекты могут иметь отверстия. Их можно пометить с помощью той же процедуры, но при этом необходимо обращать внимание не на единицы, а на нули.

Связность

Теперь нужно аккуратно рассмотреть смысл термина сосед. Если мы имеем дело с квадратным растром, то, по-видимому, соседями следует считать четыре элемента изображения, касающиеся сторон данного элемента. Но как быть с теми, которые касаются его в углах? Существуют две возможности:

— четырехсвязность – соседями считаются только элементы, примыкающие к сторонам;

— восьмисвязность – элементы, касающиеся в углах, также считаются соседями. Указанные возможности приведены на следующих диаграммах:

Оказывается, ни одна из этих схем не является полностью удовлетворительной. В этом можно убедиться, если вспомнить, что фон также можно разбить на несколько связных компонент. Здесь нам хотелось бы применить наши интуитивные представления о связности областей на непрерывном бинарном изображении. Так, например, простая замкнутая кривая должна разделять изображение на две связные области (рис. 2). Это так называемая теорема Жордана о кривой.

Рис. 2. Простая замкнутая кривая, разбивающая плоскость на две связные области.

Теперь рассмотрим простое изображение, содержащее четыре элемента со значением “единица”, которые примыкают к центральному элементу со значением “нуль”:

Это — крест с выброшенным центром. Если принять соглашение о четырехсвязности, то на изображении окажутся четыре различные компоненты (![]() ,

,![]() ,

,![]() и

и ![]() ):

):

Они, естественно, не образуют замкнутой кривой, хотя центральный элемент, относящийся к фону, и не связан с остальным фоном. Несмотря на отсутствие какой-либо замкнутой кривой, у нас образовались две фоновые области. Если принять соглашение о восьмисвязности, то, наоборот, четыре элемента растра станут образовывать замкнутую кривую, и в то же время центральный элемент окажется связанным с остальным фоном:

Итак, мы получили замкнутую кривую и только одну связную компоненту фона.

Одно из решений возникшей проблемы состоит в выборе четырехсвязности для объекта и восьмисвязности для фона (или наоборот). Подобная асимметрия в трактовке объекта и фона часто нежелательна, и ее можно избежать путем введения другого типа асимметрии. Будем считать соседями четыре элемента изображения, примыкающие к данному по сторонам, а также два из четырех элементов, касающихся в углах:

или

или

Для обеспечения симметричности отношения связности два угловых элемента должны находиться на одной и той же диагонали: если элемент А — сосед элемента В, то элемент В должен быть соседом элемента А. В дальнейшем мы будем пользоваться первым из двух возможных вариантов, приведенных выше, считая соседями элементы в направлениях N, E, SE, S, W и NW. С помощью шестисвязности как объект, так и фон можно трактовать единообразно без каких-либо дальнейших неувязок. Для изображений на квадратном растре мы примем именно такое соглашение.

На гексагональном растре рассуждения проще. Все шесть элементов растра, касающиеся данного центрального элемента, являются соседями, так что неопределенности не возникает. Наши предыдущие действия можно рассматривать как простой перекос квадратной решетки и превращение ее в гексагональную. Чтобы в этом убедиться, зафиксируем произвольный элемент и сдвинем ряд, находящийся над ним, на половину ширины элемента вправо, а ряд, находящийся под ним, — на ту же величину влево:

Теперь выбранный элемент касается шести других, и они в точности такие, которые мы выбрали при определении шестисвязности.

Локальные вычисления и итеративная модификация

До сих пор основное внимание уделялось последовательной обработке информации, содержащейся в бинарном изображении. Чтобы повысить скорость обработки и использовать возможности больших интегральных схем (БИС), необходимо также рассмотреть, какие результаты можно получить с помощью параллельно выполняемых локальных операций. Под локальной мы понимаем то, что на вход каждой такой операции поступает информация лишь с небольшого участка изображения.

Имеются два типа вычислений, выполнимых таким образом. Мы можем скомбинировать (сложить) результаты всех локальных операций и завершить тем самым работу в один шаг (рис. 5) или создать новое изображение на основе этих результатов.

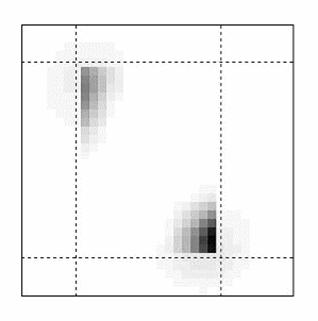

Рис. 5. Методы локальных вычислений. Комбинируются выходы отдельных вычислительных ячеек, каждая из которых соединена с несколькими элементами изображения, лежащими вблизи нее.

Локальные вычисления.

Рассмотрим очень простой случай. Каждый из локальных операторов обращается к одному элементу изображения и выдает его значение. После сложения всех таких выходов в качестве результата получим суммарную площадь объектов, находящихся в поле зрения. Таким образом, параллельный способ вычисления площади требует всего одного шага (проблему суммирования всех нулей и единиц мы здесь не рассматриваем).

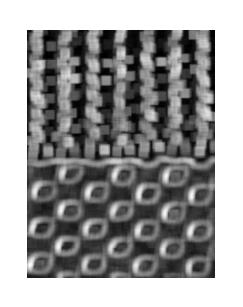

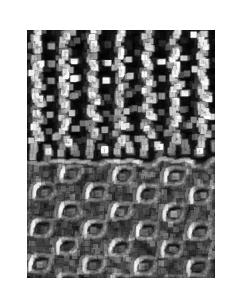

Какие другие характеристики представимы в виде суммы результатов локальных операций? Например, периметр: достаточно просто подсчитать количество участков на изображении, где рядом с нулями стоят единицы. Имеются два типа локальных операторов (рис. 6): операторы одного типа просматривают два соседних элемента, расположенных в одной строке, а операторы другого типа — два соседних элемента, расположенных в одном столбце. В обоих случаях результат есть ИСКЛЮЧАЮЩЕЕ ИЛИ (аÄb) двух значений на входе. Сумма всех получаемых выходов представляет собой оценку периметра.

Рис. 6. Возможность использования операции ИСКЛЮЧАЮЩЕЕ ИЛИ к двум соседним элементам изображения для выделения участков, находящихся на границе областей.

Каждый из двух типов операторов реагирует на два типа шаблонных ситуаций. Здесь показаны два случая, включающие горизонтальный и вертикальный детекторы.

|

|

|

Вычисленный периметр представляет собой лишь приблизительную оценку, поскольку, как правило, дискретное бинарное изображение строится на основе непрерывного, и при этом границы объектов становятся более изрезанными. Например, оценка длины диагональной прямой в ![]() раз больше “истинной”:

раз больше “истинной”:

Усреднение по всем углам наклона дает среднее значение коэффициента, показывающего, во сколько раз увеличено полученное значение. Оно составляет 4/![]() =1,273.... Разделив на это число, можно улучшить оценку периметра.

=1,273.... Разделив на это число, можно улучшить оценку периметра.

Кроме площади и периметра с помощью локальных методов можно вычислить число Эйлера, которое определяется как разность между количеством объектов и количеством отверстий.

Бинарные изображения можно комбинировать разными путями. Можно осуществить операцию ИЛИ. В результате мы объединим два изображения в одно. Можно осуществить операцию И. В этом случае мы получим пересечение объектов. Большой интерес представляет то, как характеристики получаемых подобными способами изображений соотносятся с характеристиками исходных изображений. Одна из причин такого интереса связана с надеждой разбить изображение на большое число частей, одновременно обработать все эти части и затем объединить результат.

Если обозначить исходные изображения через ![]() и

и ![]() , то логические операции ИЛИ и И над

, то логические операции ИЛИ и И над ![]() и

и ![]() обозначаются соответственно

обозначаются соответственно ![]() и

и ![]() . Площади удовлетворяют соотношению

. Площади удовлетворяют соотношению ![]() , поскольку сумма площадей

, поскольку сумма площадей ![]() и

и ![]() равна площади их объединения плюс площадь тех частей, где они перекрываются. О любой числовой характеристике бинарного изображения, удовлетворяющей этому условию говорят, что она обладает свойством аддитивности.

равна площади их объединения плюс площадь тех частей, где они перекрываются. О любой числовой характеристике бинарного изображения, удовлетворяющей этому условию говорят, что она обладает свойством аддитивности.

Итеративная модификация

Значение каждого элемента нового изображения можно определить как результат локальной операции над соответствующим элементом исходного изображения. Полученное бинарное изображение можно снова подвергнуть обработке в следующем цикле вычислений. Это процесс, называемый итеративной модификацией, весьма полезен, поскольку позволяет постепенно перевести трудное для обработки изображение в такое, которое поддается ранее описанным методам.

В пакете Image Processing Toolbox системы Matlab существует много функций, осуществляющих обработку бинарных изображений, в частности, морфологические операции. Среди них – BWMORPH, DILATE, ERODE, BWPERIM, MAKELUT, BWFILL, BWSELECT, IMFEATURE и другие.

Существует огромное количество трудов по обработке бинарных изображений. Вот некоторые из содержательных работ на эту тему:

- Arcelli C., Pattern Thinning by Contour Tracing, Computer Graphics and Image Processing, 17, № 3, 130 – 144 (1981).

- Dyer C.R., Rosenfeld A., Thinning Algorithms for Gray–Scale Picture, IEEE Trans. on Pattern Analysis and Machine Intelligence, 1, №1, 88 – 89 (1979).

- Stefanelli R., Some Parallel Thinning Algorithms for Digital Pictures, Jornal of the ACM, 18, № 2, 255–264 (1971).

- Хорн Б.К.П. Зрение роботов: Пер. с англ. – М.: Мир, 1989. – 487 с., ил. ISBN 5–03–000570–6.

Формирование и обработка цифровых изображений

Изображение служит для представления информации в визуальном виде. Эффективность восприятия этой информации человеком зависит от многих факторов. Максимальный учет влияния этих факторов возможен при условии изучения целого ряда вопросов, связанных со способами получения, свойствами зрительного восприятия и обработкой изображений.

Методы получения цифровых изображений

На современном этапе развитие технической и медицинской диагностики неразрывно связано с визуализацией внутренних структур объекта [1]. Существует много различных видов визуализации. Возникают новые методы, но они не заменяют уже существующие, а лишь дополняют их. Разные методы визуализации основываются на разнообразных физических взаимодействиях электромагнитного излучения с материалами, средами, биотканями и, как следствие, обеспечивают измерение разных физических свойств этих объектов. Рассмотрим несколько основных методов получения изображений, которые представляют интерес для технической и медицинской диагностики.

Системы получения рентгенографических изображений

Рентгеновское излучение активно используется для получения изображений с момента его открытия в 1895 г. Изображение формируется в результате взаимодействия квантов рентгеновского излучения с приемником и представляет собой распределение квантов, которые прошли через объект диагностики и были зарегистрированы детектором (рис. 1). Последние делятся на первичные, т.е. те, которые прошли через объект

Рис. 1. Компоненты системы для получения рентгеновских изображений. B и E - кванты, которые прошли через исследуемый объект без взаимодействия; C и D - рассеянные кванты. Квант D отсеивается сеткой, которая препятствует рассеянному излучению, а квант A - поглощается в объекте.

без взаимодействия с его материалом, и на вторичные кванты, которые получаются в результате взаимодействия с материалом объекта. Вторичные кванты, как правило, отклоняются от направления своего начального движения и несут мало полезной информации. Полезную информацию несут первичные кванты. Они дают информацию о том, что квант проходит через материал объекта без взаимодействия.

Установлено, что контраст рентгенографического изображения резко уменьшается с увеличением энергии квантов, поэтому для получения большого контраста необходимо использовать излучение низкой энергии. Но это означает высокую дозу облучения, и потому должен быть найден некоторый компромисс между достаточным контрастом и наименьшей дозой облучения.

Даже если система получения изображений имеет высокую контрастность и хорошую дискретность, в случае высокого уровня шумов, перед рентгенологами возникают серьезные проблемы, связанные с идентификацией больших структур. Уровень шумов можно понизить за счет увеличения числа квантов, которые формируют изображение. Но при этом возрастает также доза облучения, поэтому необходимо принимать во внимание соотношения между двумя этими величинами.

Стандартные аналоговые системы осуществляют формирование и отображение информации аналоговым путем. Тем не менее, аналоговые системы имеют очень жесткие ограничения на экспозицию через маленький динамический диапазон, а также довольно скромные возможности по обработке изображений. В отличие от аналоговых, цифровые рентгенографические системы разрешают получать изображение при любой необходимой дозе и дают широкие возможности относительно их обработки.

Блок-схема типичной цифровой рентгенографической системы представлена на рис. 2.

Рис. 2. Элементы цифровой системы получения рентгеновских изображений.

Рентгеновский аппарат и приемник изображения связаны с компьютером, а полученное изображение запоминается и отображается (в цифровой форме) на телеэкране.

В цифровой рентгенографии используют такие приемники изображения как усилитель изображения, ионографическая камера и устройство с вынужденной люминесценцией. Эти приемники могут непосредственно формировать цифровые изображения без промежуточной регистрации. Усилители изображения не имеют наилучшей пространственной разрешающей способности или контраста, но имеют высокое быстродействие. Аналогово-цифровое преобразование флюорограммы с числом точек на изображении  может занимать время меньшее, чем

может занимать время меньшее, чем ![]() с. Даже при числе точек на изображении

с. Даже при числе точек на изображении  время его превращения в цифровую форму составляет всего несколько секунд. Время считывания из пластины с люминесценцией или с ионографической камеры значительно больше, хотя здесь лучшая разрешающая способность и динамический диапазон.

время его превращения в цифровую форму составляет всего несколько секунд. Время считывания из пластины с люминесценцией или с ионографической камеры значительно больше, хотя здесь лучшая разрешающая способность и динамический диапазон.

Записанное на фотопленке изображение можно перевести в цифровую форму с помощью сканирующего микроденситометра, но любая информация, зафиксированная на фотопленке с очень маленькой или очень высокой оптической плотностью, будет обезображена влиянием характеристик пленки. В цифровую форму можно превратить и ксерорентгенограмму также с помощью сканирующего денситометра, который работает в отраженном свете, но недостатком полученного изображения является наличие уже усиленных контуров.

К преимуществам цифровых рентгенографических систем относятся следующие факторы: цифровое отображение информации; низкая доза облучения; цифровая обработка изображений и улучшения качества. Рассмотрим эти преимущества более подробно [1-3].

Первое преимущество связано с отображением цифровой информации. Разложение изображения на уровни яркости на телеэкране или по плотности на фотопленке в цифровом виде становится в полной мере доступным для пользователя. Например, любую фотопленку, зарегистрированную с помощью цифровой обработки изображения, можно правильно экспонировать и получить характеристику, которая согласуется с соответствующими действительности значениями интенсивностей элементов изображения. И наоборот, весь диапазон оптических плотностей или яркостей может быть использован для отображения лишь одного участка диапазона яркостей изображения, которое приводит к повышению контраста в потенциально информативной области. В распоряжении оператора имеются алгоритмы для аналоговой обработки изображений с целью оптимального использования возможностей систем отображения. Метод гистограммной коррекции разрешает так обработать цифровое изображение на дисплее, что любому уровню яркости (или оптической плотности) в аналоговом изображении будут отвечать одинаковые числа ячеек яркости в цифровом отображении.

Второе преимущество цифровой рентгенологии - возможность снижения дозы облучения. Если в обычной рентгенологии доза облучения зависит от чувствительности приемника и динамического диапазона пленки, то в цифровой рентгенологии эти показатели могут оказаться несущественными.

Третье преимущество цифровой рентгенологии - это возможность цифровой обработки изображений. Рентгенолог должен обнаружить аномальные образования на осложненной фоном нормальной структуре объекта. Он может не заметить мелких деталей или пропустить слабоконтрастную структуру на фоне шумов изображения. Поэтому очень важной является возможность повышения визуального качества потенциально информативных участков для увеличения вероятности принятия правильных решений.

Получение изображений с помощью радиоизотопов

Метод, который рассматривается ниже, получил очень широкое применение в медицине. В последние десятилетия значительно развилась клиническая диагностика заболеваний человека с помощью введения в его организм радиоизотопов в индикаторном количестве. Визуализация с помощью радиоизотопов включает в себя ряд методов получения изображений, которые отражают распределение в организме меченных радионуклидами веществ. Эти вещества называются радиофармпрепаратами и предназначены для наблюдения и оценки физиологических функций отдельных внутренних органов. Характер распределения радиофармпрепаратов в организме определяется способами его введения, а также такими факторами, как величина кровотока объема циркулирующей крови и наличием того ли другого метаболического процесса.

Радиоизотопные изображения позволяют получать ценную диагностическую информацию. Наиболее распространенным методом этого класса является статическая изотопная визуализация в плоскости, которая называется планарной сцинтиграфией. Планарные сцинтиграммы представляют собой двумерные распределения, а именно проекции трехмерного распределения активности изотопов, которые находятся в поле зрения детектора. Томографические исследования с применением системы многоракурсного сбора информации об объекте разрешают преодолеть большинство проблем, связанных с наложением информации при одноракурсном способе сбора данных. Прогресс компьютерных технологий привел к применению компьютеров при исследованиях с помощью радиоизотопов, где важную роль играет томографическая и динамическая информация. Использование компьютерной техники повышает качество изображения и дает возможность при радиоизотопной визуализации получать количественную информацию об исследуемых объектах.

Ультразвуковая диагностика

Ультразвуковые методы визуализации широко применяются при разных диапазонах частот - от подводной локации и биоэхолокации (частоты до 300 КГц) до акустической микроскопии (от 12 МГц до 1ГГц и выше). Промежуточное расположение по частотам занимают ультразвуковая диагностика и терапия, а также неразрушающий контроль в промышленности. Информация о структуре исследуемого объекта закодирована в лучах, которые прошли через него и в рассеянном излучении. Задача системы визуализации состоит в расшифровке этой информации. В отличие от рентгеновских лучей, ультразвуковые волны преломляются и отбиваются на границах раздела сред с разными акустическими показателями преломления. Эти эффекты могут быть довольно заметными, что разрешает создать фокусирующие системы.

С точки зрения выбора конкретного способа построения систем визуализации, в зависимости от вида излучения между ультразвуком и рентгеновским излучением есть существенные различия. Ультразвуковые волны распространяются довольно медленно, поэтому при характерных размерах исследуемого объекта легко измерять соответствующее время распространения, которое разрешает использовать эхо-импульсные методы для формирования акустических изображений. С другой стороны, скорость ультразвуковых волн достаточно большая для того, чтобы накапливать и реконструировать всю информацию о виде полного кадра изображения за время 80 мс. Другими словами, появляется возможность наблюдать движение объектов в динамике. Ультразвуковые приборы отличаются один от другого лишь деталями.

Использование эффекта ядерного магнитного резонанса (ЯМР) для получения изображений

Несмотря на то, что во многих больших исследовательских центрах ЯМР-визуализация является одним из важных диагностических средств, сам метод еще находится на относительно ранней стадии своего развития. Само явление ядерного магнитного резонанса было открыто в 1946 году независимо Блохом и Парселлом с Паундом. Этот метод с помощью небольших изменений резонансной частоты (через наличие околомолекулярной электронной тучи) позволяет идентифицировать ядра в разном химическом окружении. Сначала ЯМР-методы с высокой разрешающей способностью разрабатывались как универсальное средство изучения химического состава и структуры твердого тела и жидкостей, а далее нашли свое применение и в других областях, в частности, медицине. Рядом с развитием ЯМР-спектроскопии развивались и методы визуализации - это и точечные методы, методы "быстрой" визуализации и прочие. Роль центрального процессора в современных ЯМР-системах выполняет мощный миникомпьютер, который обеспечивает канал связи с оператором и контроль функций узлов системы. Компьютер также обеспечивает запоминание и архивирование информации, отображение результатов исследований и во многих случаях соединяется с устройством быстрой обработки типа матричного процессора.

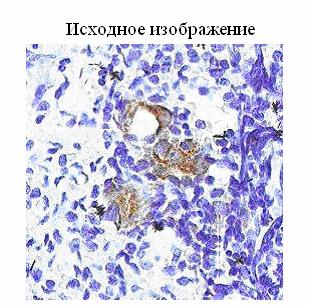

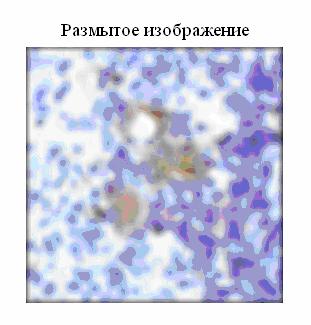

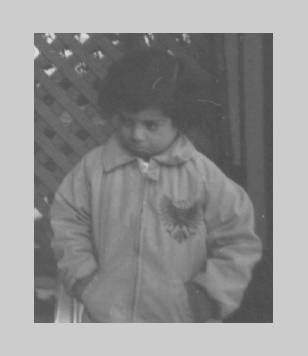

Пример обработки рентгеновских биомедицинских изображений с использованием системы MATLAB

Довольно часто рентгеновские биомедицинские изображения не отвечают тем критериям качества, которые необходимы для их достоверного анализа. Также не всегда существует возможность сделать повторный снимок. Это приводит к необходимости цифровой обработки такой информации [2, 3].

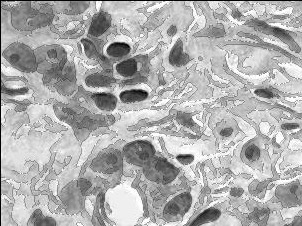

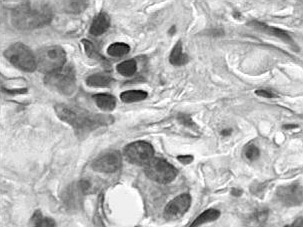

Основными недостатками рентгеновских изображений, в большинстве случаев, являются искаженные яркостные характеристики и низкая контрастность. Рассмотрим пример обработки одного из таких изображений с помощью системы MATLAB.

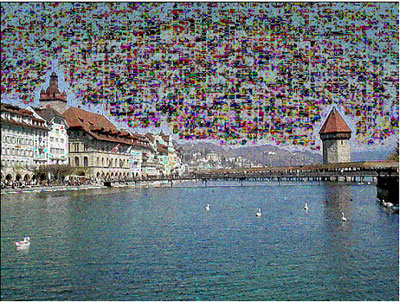

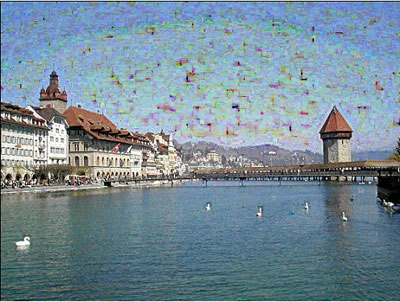

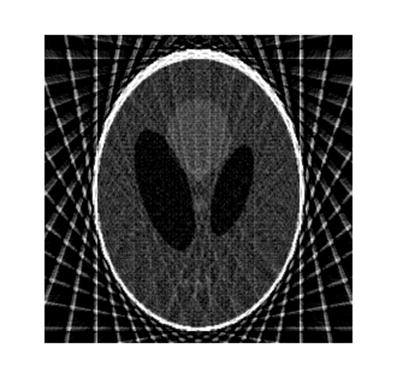

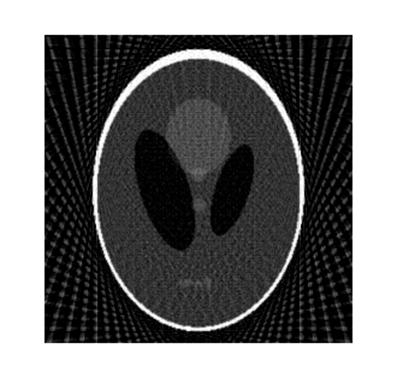

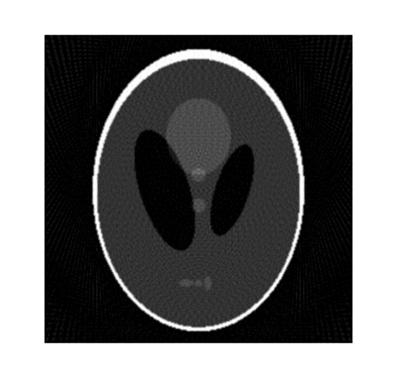

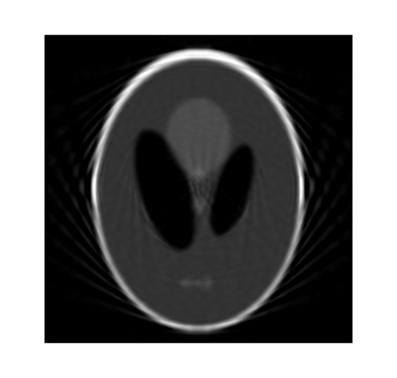

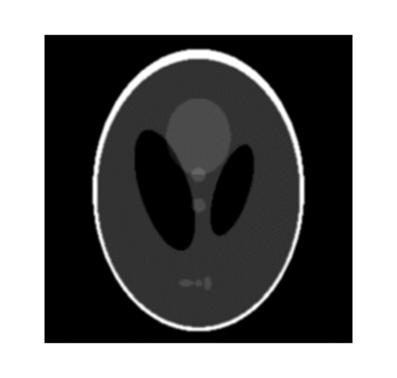

Недостаток исходного биомедицинского изображения (рис. 3а) состоит в том, что это изображение низкоконтрастное, что затрудняет анализ мелких деталей. Поэтому сначала выполняется операция растяжения гистограммы изображения на максимально допустимый диапазон (рис. 3б). Далее осуществляется контрастирование исследуемого изображения (рис. 3в). Это приводит к улучшению визуального качества рентгеновских изображений. На практике, конечно, применяются также и другие более сложные методы и алгоритмы обработки изображений такого рода.

%Пример программы обработки биомедицинских изображений в среде MATLAB

L=imread('cardial.bmp');

figure, imshow(L);

L1=imadjust(L,[min(min(L)) max(max(L))]/255,[],1);

figure, imshow(L1);

L=L1(:,:,1);

L=double(L);

Filter=[1 1 1,1 1 1,1 1 1];

Lser=filter2(Filter,L(:,:,1),'same')./9;

C=abs(L(:,:,1)-Lser)./(L(:,:,1)+Lser);

C=C.^.55;

[N M]=size(L);

for i=1:N;

disp(i);

for j=1:M;

if L(i,j,1)>Lser(i,j);

Lvyh(i,j)=Lser(i,j)*(1+C(i,j))/(1-C(i,j));

else

Lvyh(i,j)=Lser(i,j)*(1-C(i,j))/(1+C(i,j));

end;

end;

end;

figure, imshow(Lvyh/255);

|

|

|

|

Рис. 3.

- Физика визуализации изображений в медицине: в 2–х томах. Т. 2: Пер. С англ. / Под ред. С. Уэбба. – М.: Мир, 1991. – 408 с., ил.

- Беликова Т.П. Моделирование линейных фильтров для обработки рентгеновских изображений в задачах медицинской диагностики // Цифровая оптика. Обработка изображений и полей в экспериментальных исследованиях / Под ред. В.И.Сифорова и Л.П.Ярославского. – М.: Наука, 1990. – 176 с.

- Н.Н. Блинов, Е.М. Жуков, Э.Б. Козловский, А.И. Мазуров. Телевизионные методы обработки рентгеновских и гамма–изображений. М.: Энергоатоиздат, 1982. – 200 с.

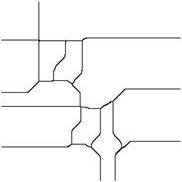

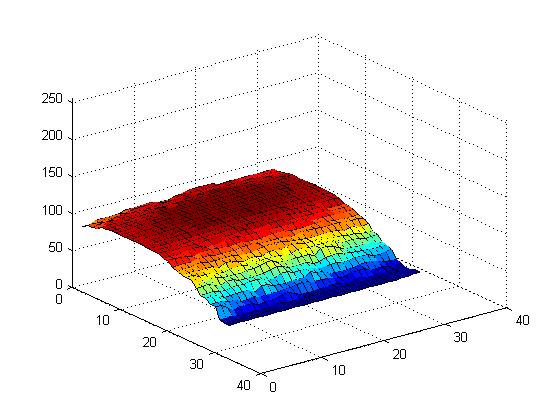

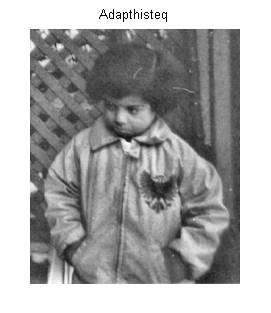

Адаптивное повышение контрастности изображений

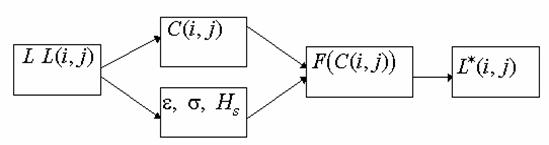

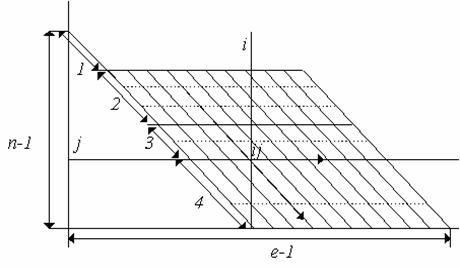

Одной из наиболее удобных форм представления информации при диагностировании материалов и изделий в неразрушающем контроле, органов человека в медицине и иных областях является изображение. Это приводит к необходимости развития способов диагностики с использованием разнообразных методов. Однако одним из существенных недостатков этих методов является то, что в большинстве своем они обеспечивают формирование низкоконтрастных изображений. Поэтому основная цель методов улучшения состоит в преобразовании изображений к такому виду, что делает их более контрастными и, соответственно, более информативнее [1]. Довольно часто на изображении присутствуют искажения в определенных локальных окрестностях, которые вызваны дифракцией света, недостатками оптических систем или розфокусировкой. Это приводит к необходимости выполнения локальных преобразований на изображении. Иными словами, такой адаптивный подход дает возможность выделить информативные участки на изображении и соответствующим образом их обработать. Изложенным требованиям отвечают методы адаптивного преобразования локального контраста [2]. Методы этого класса можно представить обобщенной структурной схемой (рис. 1), где использованы такие обозначения:

![]() - исходное изображение и его элемент с координатами

- исходное изображение и его элемент с координатами ![]() соответственно;

соответственно;

![]() - контраст элемента изображения с координатами

- контраст элемента изображения с координатами ![]() ;

;

![]() - преобразованное значение контраста

- преобразованное значение контраста ![]() ;

;

![]() - характеристики локальных окрестностей (

- характеристики локальных окрестностей (![]() - энтропия,

- энтропия, ![]() - среднеквадратичное отклонение,

- среднеквадратичное отклонение, ![]() - функция протяженности гистограммы);

- функция протяженности гистограммы);

![]() - элемент обработанного изображения с координатами

- элемент обработанного изображения с координатами ![]() .

.

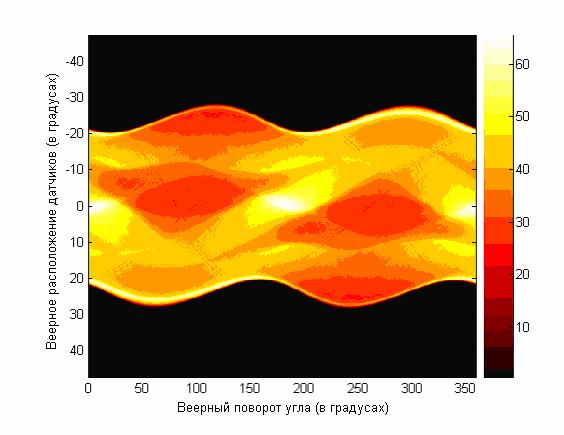

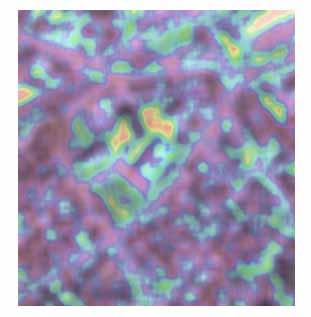

Рис. 1. Обобщенная структурная схема методов улучшения изображений с использованием адаптивного преобразования локальных контрастов.

Основные шаги реализации методов адаптивного преобразования локальных контрастов такие:

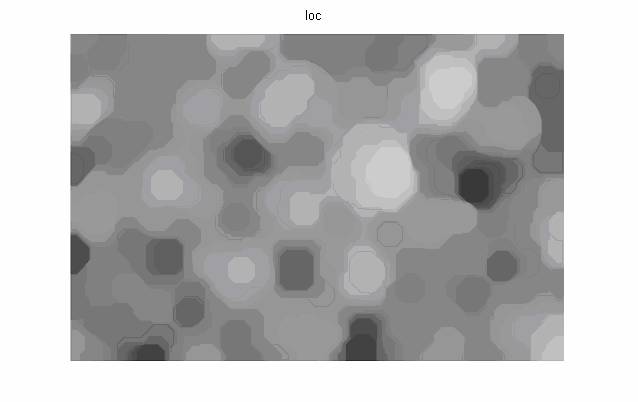

Шаг 1. Для каждого элемента изображения ![]() вычисляют значение локального контраста

вычисляют значение локального контраста ![]() в текущей окрестности

в текущей окрестности ![]() с центром в элементе с координатами

с центром в элементе с координатами ![]() .

.

Шаг 2. Вычисляют локальную статистику для текущей скользящей окрестности ![]() .

.

Шаг 3. Преобразуют (усиливают) локальный контраст ![]() , употребляя для этого нелинейные функции и учитывая локальную статистику текущей скользящей окрестности

, употребляя для этого нелинейные функции и учитывая локальную статистику текущей скользящей окрестности ![]() .

.

Шаг 4. Восстанавливают значение яркости изображения ![]() с усиленным локальным контрастом.

с усиленным локальным контрастом.

Шаги 1 и 2 могут выполняться в различной последовательности или параллельно.

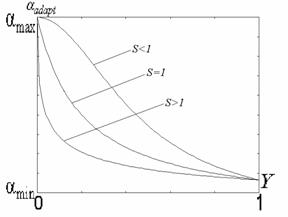

Проанализируем более детально реализацию шага 3 вышеупомянутого метода. Его суть состоит в том, что для преобразования локальных контрастов используют нелинейные монотонные функции, а для формирования адаптивной функции преобразования локального контраста выбирают степенную функцию и задают минимальное ![]() и максимальное

и максимальное ![]() значения показателя степени

значения показателя степени ![]() . Адаптация состоит в формировании дополнительного слагаемого к

. Адаптация состоит в формировании дополнительного слагаемого к ![]() путем его определения на основе локальных статистик в скользящих окрестностях. В качестве параметров, которые будут характеризовать скользящие окрестности, используются функция протяженности гистограммы

путем его определения на основе локальных статистик в скользящих окрестностях. В качестве параметров, которые будут характеризовать скользящие окрестности, используются функция протяженности гистограммы ![]() , энтропия

, энтропия ![]() и среднеквадратическое отклонение

и среднеквадратическое отклонение ![]() значений яркостей элементов скользящей окрестности. Поэтому, в зависимости от поставленной задачи, методы данного класса могут отличаться как функцией преобразования локального контраста, так и характеристикой скользящей окрестности.

значений яркостей элементов скользящей окрестности. Поэтому, в зависимости от поставленной задачи, методы данного класса могут отличаться как функцией преобразования локального контраста, так и характеристикой скользящей окрестности.

Рассмотрим более детально предложенные локально-адаптивные методы улучшения изображений, проанализируем использование характеристик локальных окрестностей в выражениях преобразования локальных контрастов и обоснуем их выбор.

Использование функции протяженности гистограммы

Рассмотрим метод повышения качества изображения, который базируется на адаптивном преобразовании локального контраста. Адаптация в данном методе осуществляется на основании анализа такой характеристики как функция протяженности гистограммы элементов локальной скользящей окрестности. Для примера будем считать, что элементы изображения представлены 8-разрядными целыми числами, то есть ![]() .

.

Основные шаги реализации этого метода такие.

Шаг 1. Вычисляем локальный контраст элемента.

Шаг 2. Определяем характеристику локальной скользящей окрестности, используя функцию протяженности гистограммы

| (1) |

где ![]() ,

, ![]() - соответственно максимальное и минимальное значения яркостей элементов скользящей окрестности с центром в элементе с координатами

- соответственно максимальное и минимальное значения яркостей элементов скользящей окрестности с центром в элементе с координатами ![]() ;

; ![]() - максимальное значение гистограммы уровней яркости элементов окрестности с центром в элементе с координатами

- максимальное значение гистограммы уровней яркости элементов окрестности с центром в элементе с координатами ![]() .

.

Шаг 3. Вычисляем степенное преобразование локального контраста, которое благодаря использованию функции протяженности гистограммы скользящей окрестности, имеет адаптивный характер:

| (2) |

где

![]() ,

,

![]() ,

, ![]() - соответственно максимальное и минимальное значения функции протяженности гистограммы для окрестности с центром в элементе с координатами

- соответственно максимальное и минимальное значения функции протяженности гистограммы для окрестности с центром в элементе с координатами ![]() .

.

Шаг 4. Восстанавливаем элемент преобразованного изображения с усиленным контрастом.

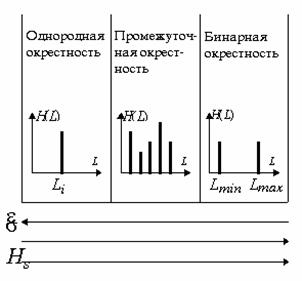

Рассмотрим более детально реализацию шагов 2 и 3 известного метода. В частности, оценим возможные значения функции протяженности гистограммы ![]() скользящей окрестности

скользящей окрестности ![]() , подразумевая, что изображениям присущи три характерные типа окрестностей.

, подразумевая, что изображениям присущи три характерные типа окрестностей.

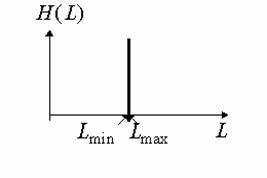

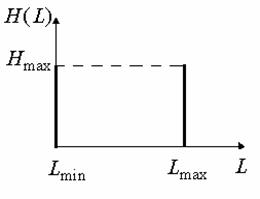

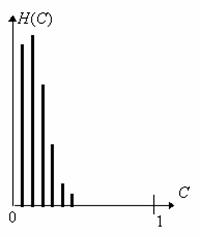

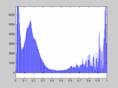

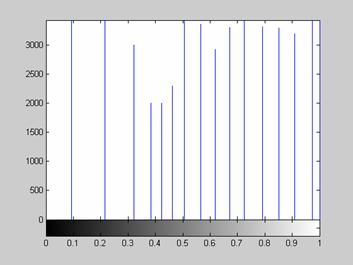

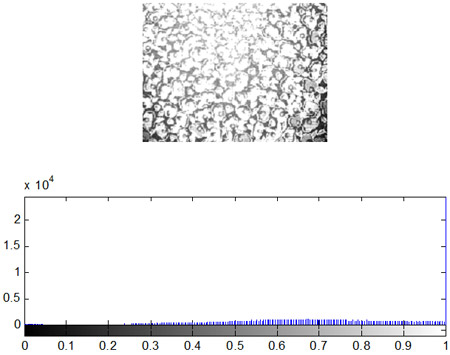

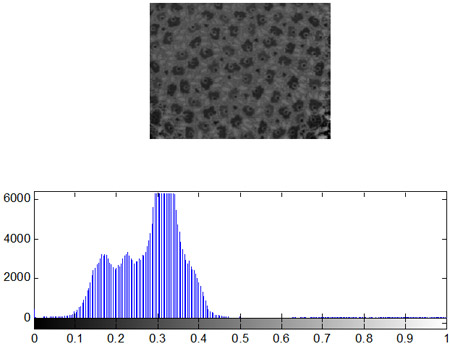

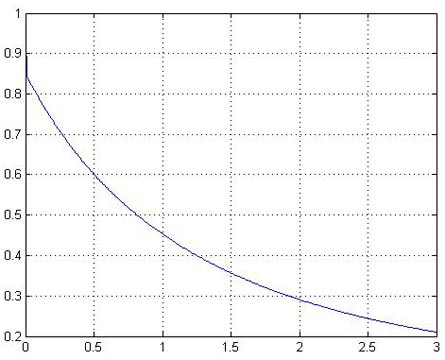

Первый тип - это однородный участок изображения, который характеризуется примерно одинаковыми уровнями яркостей элементов; гистограмма такой окрестности показана на рис. 2.

С рис. 2 видно, что ![]() , а следовательно , согласно выражению (1), функция протяженности гистограммы локальной окрестности

, а следовательно , согласно выражению (1), функция протяженности гистограммы локальной окрестности ![]() будет равна нулю.

будет равна нулю.

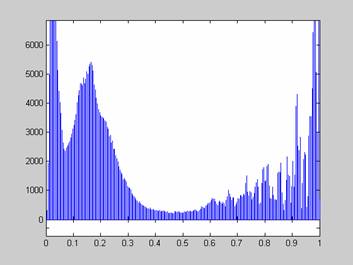

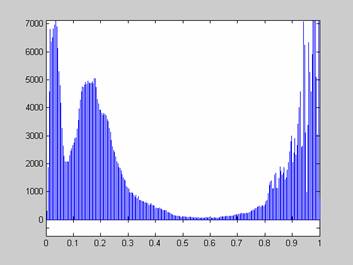

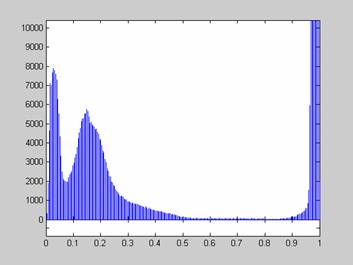

Рис. 2. Гистограмма распределения яркостей элементов однородной окрестности.

Локальные контрасты таких участков изображения усиливать не нужно, поскольку это приведет к возникновению дополнительных искажений, обусловленных усилением шумовой составляющей изображения.

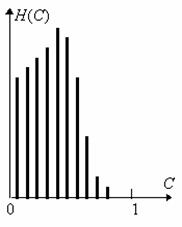

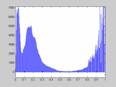

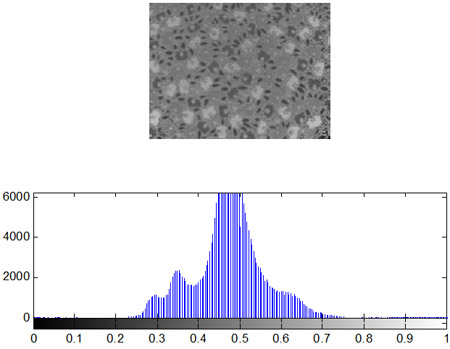

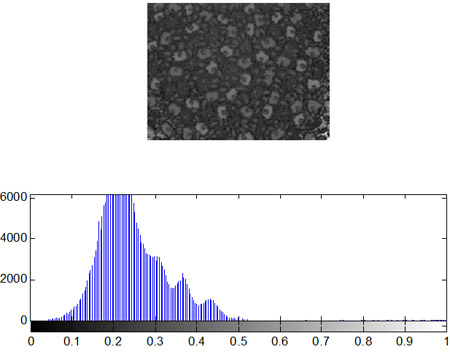

Для бинарных участков изображения с примерно одинаковым количественным соотношением элементов ![]() и

и ![]() в скользящей окрестности

в скользящей окрестности ![]() , характерна гистограмма яркостей, которая представлена на рис. 3.

, характерна гистограмма яркостей, которая представлена на рис. 3.

Рис. 3. Гистограмма распределения яркостей элементов бинарной окрестности.

Предполагая, что для темных и светлых элементов бинарной окрестности с примерно равным количественным соотношением максимальное значение гистограммы будет равно

| (3) |

где ![]() и

и ![]() - размеры скользящей окрестности

- размеры скользящей окрестности ![]() , выражение (1) будет иметь вид

, выражение (1) будет иметь вид

| (4) |

Если ![]() ,

, ![]() , а размеры

, а размеры ![]() локальной окрестности такие, что допускают присутствие элементов со всеми возможными уровнями яркостей

локальной окрестности такие, что допускают присутствие элементов со всеми возможными уровнями яркостей ![]() [0,255], например

[0,255], например ![]() элементов, тогда функция протяженности гистограммы в соответствии с выражением (4) примет значение

элементов, тогда функция протяженности гистограммы в соответствии с выражением (4) примет значение ![]() .

.

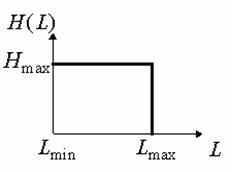

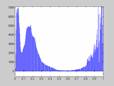

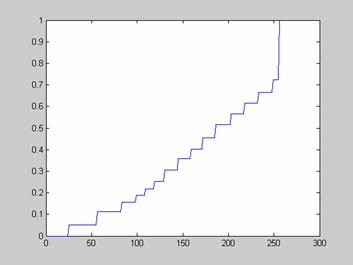

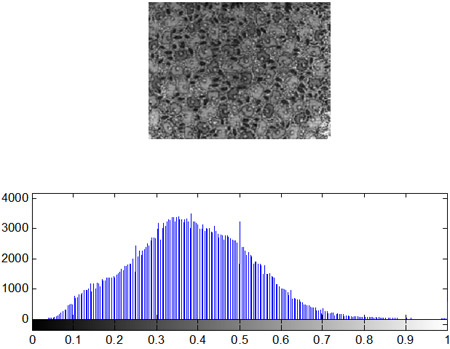

Третьим характерным типом возможной локальной окрестности является такая окрестность, где в примерно одинаковой мере присутствуют элементы со всеми возможными яркостями с диапазона [0,255]. Такие окрестности характеризуются гистограммой равномерного распределения яркостей, которая показана на рис. 4. Тогда согласно изложенных предположений относительно размера локальной окрестности и характера его гистограммы получим, что ![]() ,

, ![]()

![]() . В этом случае функция протяженности гистограммы примет значение

. В этом случае функция протяженности гистограммы примет значение ![]() . Для такой окрестности будем считать, что она высококонтрастна и не нуждается в усилении контраста.

. Для такой окрестности будем считать, что она высококонтрастна и не нуждается в усилении контраста.

Рис. 4. Гистограмма скользящей окрестности с равномерно распределенными яркостями элементов.

Выше были рассмотрены граничные случаи локальных окрестностей. Все другие окрестности характеризуются такими значениями функций протяженности гистограммы, которые находятся в диапазоне [0,255].

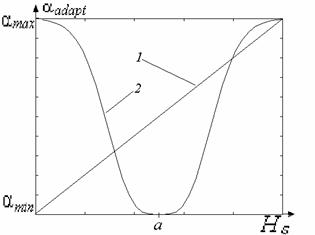

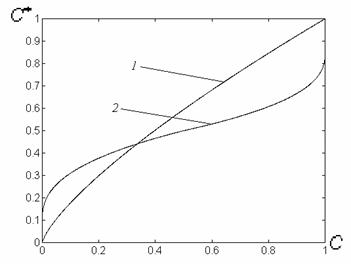

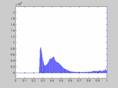

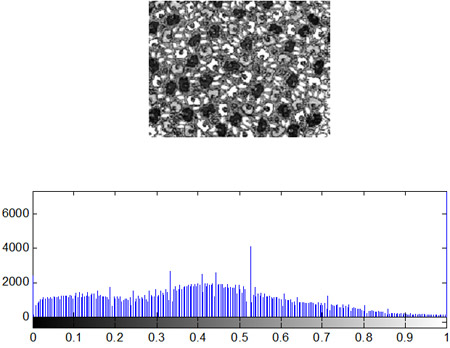

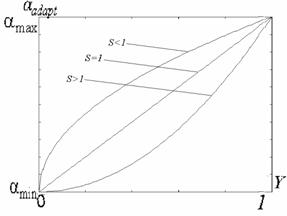

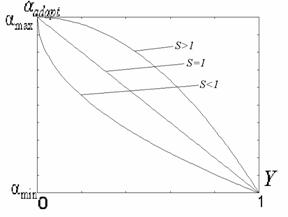

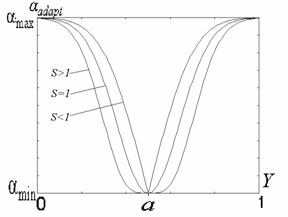

На основании анализа рассмотренных типов окрестностей и соответствующих им значений функций протяженности гистограммы, можно более объективно подойти к формированию степенной функции преобразования локального контраста. Наиболее удобно такой анализ проводить с помощью графического представления функции преобразования локального контраста (рис. 5 , прямая 1). Укажем при этом, что ![]() и уменьшение

и уменьшение ![]() отвечает более высокому усилению локального контраста, а увеличение - более слабому его усилению.

отвечает более высокому усилению локального контраста, а увеличение - более слабому его усилению.

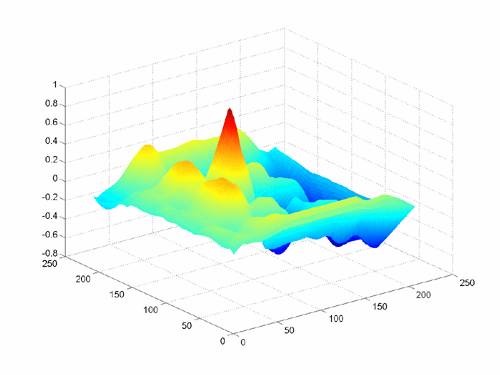

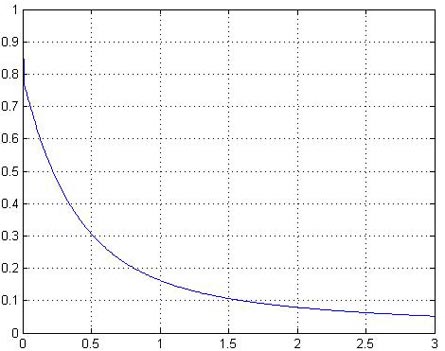

Рис. 5. Зависимость показателя степени ![]() преобразования локального контраста от функции протяженности гистограммы

преобразования локального контраста от функции протяженности гистограммы ![]() : 1 - в известном подходе [1], 2 - в предложенном методе.

: 1 - в известном подходе [1], 2 - в предложенном методе.

С рис. 5 (прямая 1) видно, что максимальное усиление локального контраста испытывают однородные участки изображения (![]() ), что не всегда желательно. Ведь однородные участки очень чувствительны к помехам, поэтому чрезмерное усиление их контраста приведет к значительным искажениям. Экспериментальные исследования показывают, что максимальному усилению (

), что не всегда желательно. Ведь однородные участки очень чувствительны к помехам, поэтому чрезмерное усиление их контраста приведет к значительным искажениям. Экспериментальные исследования показывают, что максимальному усилению (![]() ) должны подвергаться локальные контрасты в таких скользящих окрестностях, для которых функция протяженности гистограммы приобретает значения с середины диапазона

) должны подвергаться локальные контрасты в таких скользящих окрестностях, для которых функция протяженности гистограммы приобретает значения с середины диапазона ![]() .

.

В соответствии с изложенными требованиями нами предложено использовать степенную функцию преобразования локального контраста, характер изменения показателя степени которой отвечает представленному на рис. 5 (кривая 2).

Выражение для определения ![]() (рис. 5 , кривая 2) такое:

(рис. 5 , кривая 2) такое:

| (5) |

где ![]() - значение функции протяженности гистограммы, которое отвечает наиболее информативным участкам изображения

- значение функции протяженности гистограммы, которое отвечает наиболее информативным участкам изображения ![]() ;

; ![]() - постоянный коэффициент (

- постоянный коэффициент (![]() ).

).

Предложенное выражение (5) для модифицированного степенного преобразования позволяет более четко идентифицировать различные типы локальных окрестностей изображения и адаптивно усиливать их контраст в зависимости от значений локальных характеристик этих окрестностей.

Метод усиления контраста с использованием функции протяженности гистограммы эффективно используется в обработке широкого класса изображений. Учитывая характеристики скользящих окрестностей удается идентифицировать участки изображения по уровню контрастности и соответствующим образом на них реагировать. Благодаря этому достигается более тонкая обработка мелких деталей. Однако изображения должны отвечать двум требованиям. Они не должны содержать большого количества импульсных выбросов и темные или светлые участки большой площади. Ведь в первом случае это может привести к неадекватному вычислению функции протяженности гистограммы, а во втором - к неэффективному усилению контраста. Поэтому, если изображение не отвечает указанным выше требованиям, следует провести его фильтрацию или (и) градационную коррекцию.

%Программа, реализующая метод повышения контрастности изображения

%с использованием функции протяженности гистограммы

%=======Считывание данных======

clear;

L=imread('test.bmp');%Исходное изображение полутоновое, поэтому L(:,:,1)=L(:,:,2)=L(:,:,3);

L=L(:,:,1);

L=im2double(L);

m=15;n=m;n1=fix(n/2);m1=fix(m/2); %Определение размеров локальных окрестностей

%=======Преобразование матрицы яркостей изображения для устранения краевого эффекта=======

%=======В новых версиях системы Matlab существуют функции, которые реализуют эту процедуру=======

a=L(1,1);b=L(1,M);c=L(N,1);d=L(N,M);

for i=1:n1;

for j=1:m1;

L1(i,j)=a; L3(i,j)=b; L6(i,j)=c; L8(i,j)=d;

end;

end;

L2=L(1,1:M); L02=L2;

for i=1:n1-1;

L2=[L2;L02];

end;